Google, yapay zeka çağını "Agentic AI" olarak adlandırdığı ve bu alanda büyük ilerlemeler kaydettiğini duyurdu. Şirket, bu vizyonu hayata geçirmek için geliştirdiği yeni nesil süper bilgisayarlarını "Hiper Bilgisayar" olarak adlandırıyor. Bu yeni sistemler, TPUv8 serisi, NVIDIA Rubin ve Axion CPU'ları bir araya getirerek, şimdiye kadar inşa edilmiş en esnek ve performanslı yapay zeka altyapısını sunmayı hedefliyor.

Google Cloud Next '26 etkinliğinde resmi olarak tanıtılan AI Hypercomputer, gelişmiş ve amaca yönelik olarak tasarlanmış bir veri merkezi mimarisine sahip. Bu mimari, hesaplama, depolama, ağ bağlantısı, açık kaynaklı yazılım ve makine öğrenmesi çatılarının performansını optimize eden donanımları birleştiriyor.

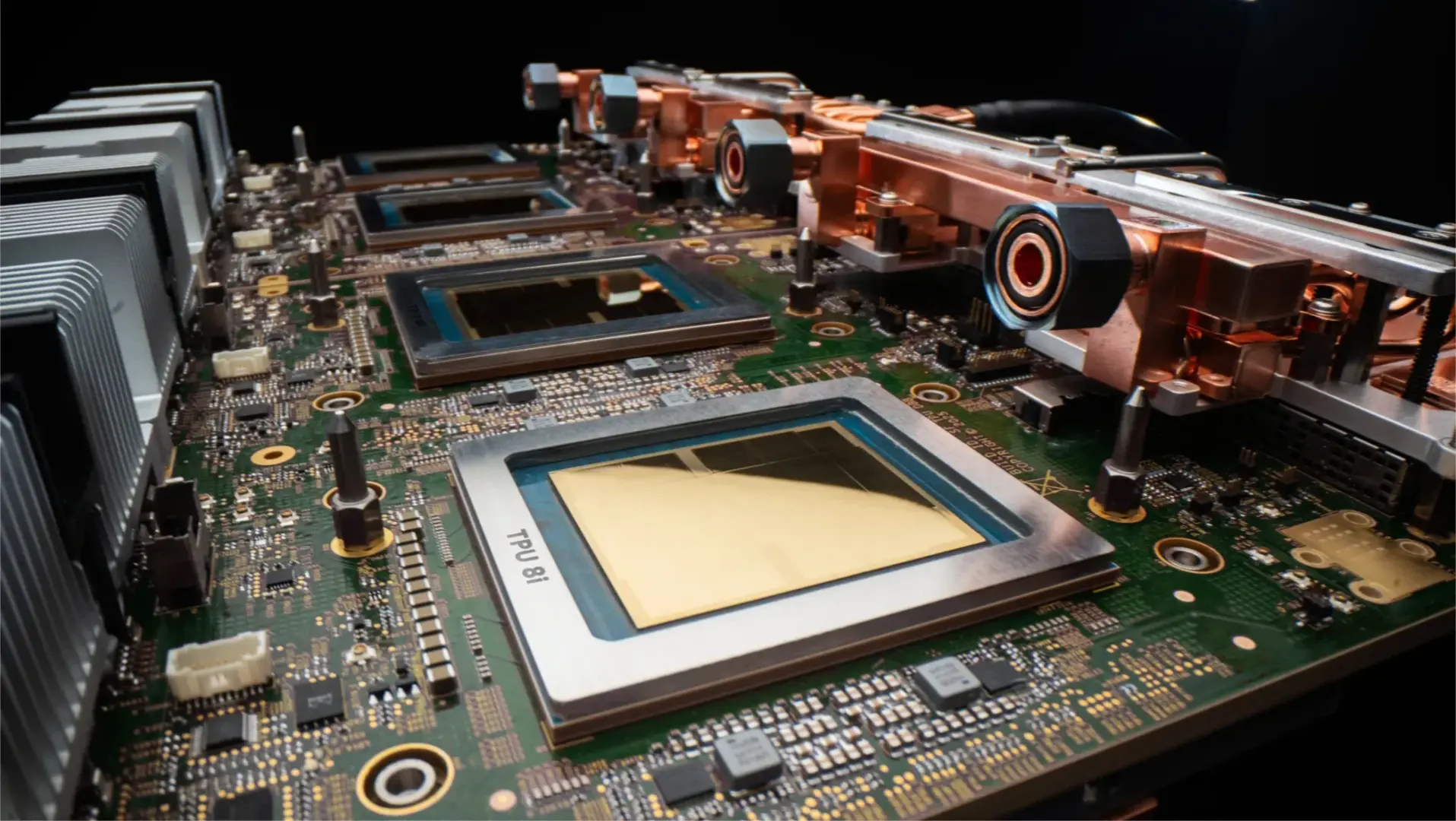

Google'ın Yeni Nesil TPU'ları: TPU 8t ve TPU 8i

Google'ın AI Hypercomputer'ının temelini oluşturan en önemli bileşenlerden biri, şirketin kendi geliştirdiği 8. Nesil TPU (Tensor Processing Unit) ailesi. Bu nesil TPU'lar iki farklı modelden oluşuyor:

Google TPU 8t - Eğitim Odaklı Çip

TPU 8t, en gelişmiş modellerin eğitim süreçlerini büyük ölçüde hızlandırmak üzere tasarlanmış. Mevcut nesilden ay bazında 2.84 kat daha yüksek işlem gücü sunan bu çip, eğitim sürelerini aylardan haftalara indirmeyi hedefliyor. En yüksek işlem verimliliği, paylaşımlı bellek ve çip içi bant genişliği özelliklerine sahip TPU 8t, güç tüketimi açısından da oldukça verimli.

Temel Özellikler:

- Devasa Ölçek: Tek bir TPU 8t süper podu, 9.600 çipe kadar ölçeklenebiliyor ve önceki nesle göre iki katı çip içi bant genişliği sunan iki petabayt paylaşımlı, yüksek bant genişliğine sahip belleğe erişebiliyor. Bu mimari, en karmaşık modellerin bile tek bir büyük bellek havuzundan faydalanmasını sağlıyor.

- Maksimum Kullanım: 10 kat daha hızlı depolama erişimi ve TPUDirect teknolojisi sayesinde verilerin doğrudan TPU'lara aktarılması, sistemin uçtan uca maksimum düzeyde kullanılmasını sağlıyor.

- Neredeyse Doğrusal Ölçeklenme: Yeni Virgo ağı, JAX ve Pathways yazılımlarıyla birleştiğinde, TPU 8t'nin tek bir mantıksal kümede bir milyon çipe kadar neredeyse doğrusal bir ölçeklenme performansı sunmasına olanak tanıyor.

- Yerel FP4 Desteği: TPU 8t, bellek bant genişliği darboğazlarını aşmak için yerel 4-bit kayan nokta (FP4) desteği sunuyor. Bu özellik, MXU verimliliğini ikiye katlarken, düşük hassasiyetli nicelemeyle bile büyük modellerde doğruluğu koruyor. Parametre başına bit miktarını azaltarak, enerji yoğun veri hareketlerini en aza indiriyor ve daha büyük model katmanlarının yerel donanım tamponlarına sığmasını sağlıyor.

Google TPU 8i - Çıkarım Odaklı Çip

TPU 8i ise özellikle yapay zeka modellerinin çıkarım (inference) işlemleri için optimize edilmiş. 288 GB HBM belleği ve 384 MB on-chip SRAM'i ile önceki nesle göre kapasitesi 3 kat artırılmış. Bu geniş SRAM sayesinde, modeller tamamen çip üzerinde aktif tutulabiliyor. TPU 8i, önceki nesle göre 6.74 kat daha yüksek, 331.8 Exaflops FP8 işlem gücü sunuyor.

Temel Özellikler:

- Axion Tabanlı Verimlilik: Şirketin kendi geliştirdiği Axion Arm tabanlı CPU'lar kullanılarak fiziksel CPU ana bilgisayar sayısı ikiye katlanmış ve NUMA mimarisi ile izolasyon sağlanarak sistem performansı optimize edilmiş.

- MoE Modelleri İçin Ölçeklenme: Modern Mixture of Experts (MoE) modelleri için çip içi bağlantı (ICI) bant genişliği 19.2 Tb/s'ye çıkarılmış. Yeni Boardfly mimarisi, ağ çapını %50'den fazla azaltarak sistemin düşük gecikmeli, tek bir birim gibi çalışmasını sağlıyor.

- Gecikmeyi Ortadan Kaldırma: Yeni çip içi Toplu İşlem Hızlandırma Motoru (CAE), global işlemleri devralarak çip içi gecikmeyi 5 kata kadar azaltıyor.

Nesilden nesile getirilen iyileştirmelerde, TPU8t Eğitim çipi, büyük ölçekli eğitimlerde Ironwood'a kıyasla dolara başına %2.7 daha iyi performans sunarken, TPU8i Çıkarım çipi, MoE modellerinde düşük gecikme hedefleri için dolara başına %80 daha iyi performans sağlıyor. Her iki çip de AI TCO (Toplam Sahip Olma Maliyeti) için hayati önem taşıyan, wat başına iki kat daha fazla performans sunuyor.

Her iki çip de, hava soğutmanın yetersiz kaldığı yüksek hesaplama ve performans yoğunluklarını destekleyebilen Google'ın 4. Nesil sıvı soğutma teknolojisini destekliyor.

Google AI Hypercomputer'ın Ana Bileşenleri

Google AI Hypercomputer'ın öne çıkan diğer bileşenleri şunlardır:

- TPU 8t (Eğitim için optimize): Devrim niteliğindeki Çip İçi Bağlantı (ICI) teknolojisini kullanarak tek bir süper podda 9.600 TPU'ya ve 2 PB paylaşımlı, yüksek bant genişliğine sahip belleğe ölçeklenebiliyor. Ironwood'a göre 3 kat daha fazla işlem gücü ve wat başına 2 kat daha fazla performans sunuyor.

- TPU 8i (Çıkarım için optimize): Yeni Boardfly topolojisi ile tek bir podda 1.152 TPU'yu doğrudan bağlıyor. Önceki nesillere göre 3 kat daha fazla on-chip SRAM'e sahip ve özel bir Toplu İşlem Hızlandırma Motoru içeriyor. Bu özelliklerle, çıkarım için önceki nesle göre dolara başına %80 daha iyi performans sağlıyor.

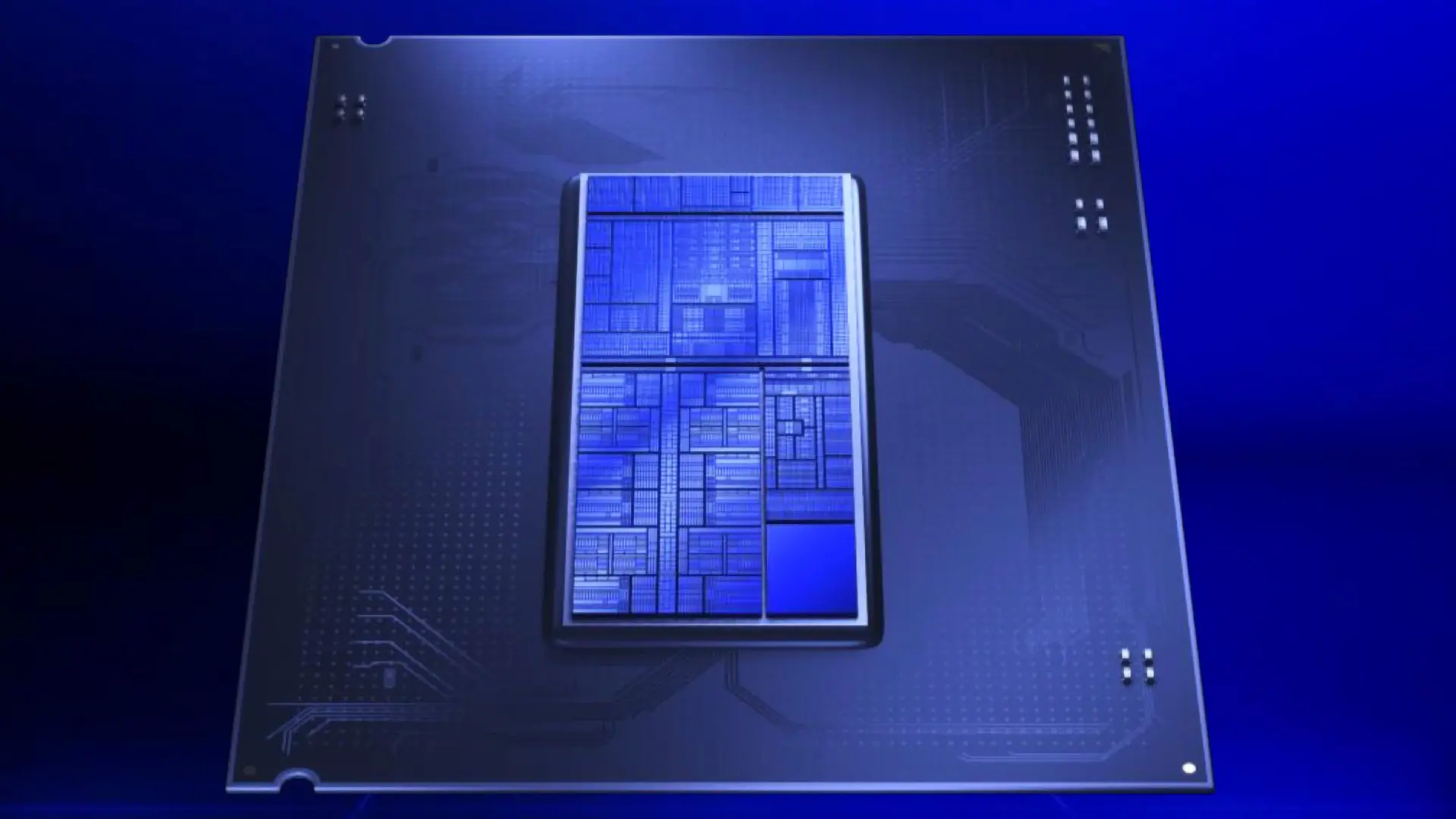

- NVIDIA GPU'lar: Google'ın yapay zeka hızlandırıcı portföyünün temel bir parçası olarak yer alıyor. Mevcut Blackwell ve Hopper tabanlı örneklerin yanı sıra NVIDIA Vera Rubin NVL72'yi de sunacaklar.

- Google Cloud Axion: Ocak ayında önizlemesi başlatılan N4A Axion örnekleri, benzer x86 örneklerine göre %100 daha iyi fiyat/performans sunarak ajanların sürdürülebilir ve verimli çalışmasını sağlıyor.

- Ağ Odaklı Hesaplama: Yüksek hacimli ajan iletişimi, ağ yoğunluklu Telco 5G çekirdekleri ve kurumsal veritabanları için optimize edilmiş yeni C4N ve M4N makine serileriyle genişletiliyor. C4N örnekleri, standart C4 örneklerine göre vCPU başına neredeyse 4 kat daha fazla ağ bant genişliği sunabiliyor.

- Depolama Yenilikleri: Yönetilen Lustre, artık RDMA üzerinden A5X veya TPU 8t'ye saniyede 10 TB veri aktarım hızı sunarak eğitimi hızlandırıyor. Rapid Storage'da ise saniyede 6 TB'den 15 TB'ye çıkan önemli performans artışları sağlanmış. Ayrıca, yapılandırılmamış verilere anlamsal anlam katan ve Kurumsal Bilgi Grafiğinin temelini oluşturan Smart Storage da tanıtılıyor.

- Ağ Yenilikleri: Yeni Virgo Ağı, NVIDIA Vera Rubin NVL72 sistemlerini veya TPU 8t süper podlarını yüz binlerce hızlandırıcıdan oluşan devasa süper bilgisayarlara bağlayan, AI için özel olarak tasarlanmış yeni bir ağ. Bu ağ, dünyanın en yetenekli öncü modellerinin dağıtık eğitimini büyük ölçüde hızlandırıyor.

Google Cloud, NVIDIA VR200 (Vera Rubin) hızlandırıcılarını sunan ilk yapay zeka altyapılarından biri olacak. Rubin GPU'ları, Google'ın 8. Nesil TPU ailesiyle birlikte devasa ölçekli eğitim kümeleri sunacak.

Google AI Hypercomputer, ABD Enerji Bakanlığı, Boston Dynamics, Citadel Securities, Thinking Machine Labs ve Axia Energy gibi büyük isimlerin de aralarında bulunduğu birçok müşteri tarafından kullanılacak.