Yapay zeka alanında önemli bir gelişme yaşandı. Yapay zeka laboratuvarı DeepSeek, geliştirdiği V4 modeliyle token çıkarımı ve bellek kullanımı konusunda devrim niteliğinde bir ilerleme kaydettiğini duyurdu. Şirketten yapılan açıklamalara göre, V4 yapay zeka modeli, önceki versiyonu olan V3.2'ye kıyasla yalnızca %27 tek token çıkarım FLOP'u ve %10 daha az anahtar-değer (KV) önbelleği gerektiriyor. Bu bellek azaltımı, özellikle büyük bağlam pencereleriyle çalışan yapay zeka modelleri için büyük bir kolaylık sağlıyor. Modellerin daha az bellek kullanması, geliştiricilerin daha geniş bağlam pencereleri oluşturmasına ve daha karmaşık görevleri yerine getirmesine olanak tanıyor.

DeepSeek V4 Hesaplama ve Bellek Maliyetlerini Nasıl Düşürüyor?

DeepSeek, V4 modelinin sürüm notlarında, yeni modelin bir milyon tokenlık bağlam penceresini çalıştırırken yalnızca %27 tek token çıkarım FLOP'u ve %10 anahtar-değer (KV) önbelleği kullandığını belirtiyor. Bağlam penceresi, bir yapay zeka büyük dil modelinin belleği serbest bırakmadan önce işleyebildiği metin miktarıdır.

Bu geliştirilmiş bellek kullanımı, özellikle yapay zeka hesaplamalarının Decode aşaması için büyük önem taşıyor. Yapay zeka modelleri çıktılarını Decode aşamasında ürettiği için, Prefill aşamasında aldığı konuşma bağlamını veya istemini depolaması gerekiyor. Bu nedenle Decode aşaması, özellikle anahtar-değer (KV) önbelleği söz konusu olduğunda Prefill aşamasından daha fazla bellek gerektiriyor.

Ödünleşme: Agresif Sıkıştırma ve "Samanlıkta İğne" Hataları

Bağlamdaki token sayısı arttıkça KV önbelleği gereksinimleri de artar. Bu da bir milyon tokenlık bir bağlamda, daha düşük önbellek kullanan bir modelin daha fazla isteği işleyebileceği veya daha az bellek kaynağı gerektireceği anlamına gelir.

DeepSeek'in V4 modelinin %27 tek çıkarım token FLOP'u gerektirdiği iddiası, GPU'nun hesaplama yapması için yeterli bellek mevcutsa performansı iyileştirir. Ek olarak, önemli ölçüde daha az önbellek belleği kullanmak, modelin ödünleşmelere dayanmasına neden olur ve bu da spesifik detayları kaçırmasına yol açabilir. Buna "samanlıkta iğne" hatası denir ve hassas olmayan çıktılara neden olabilir.

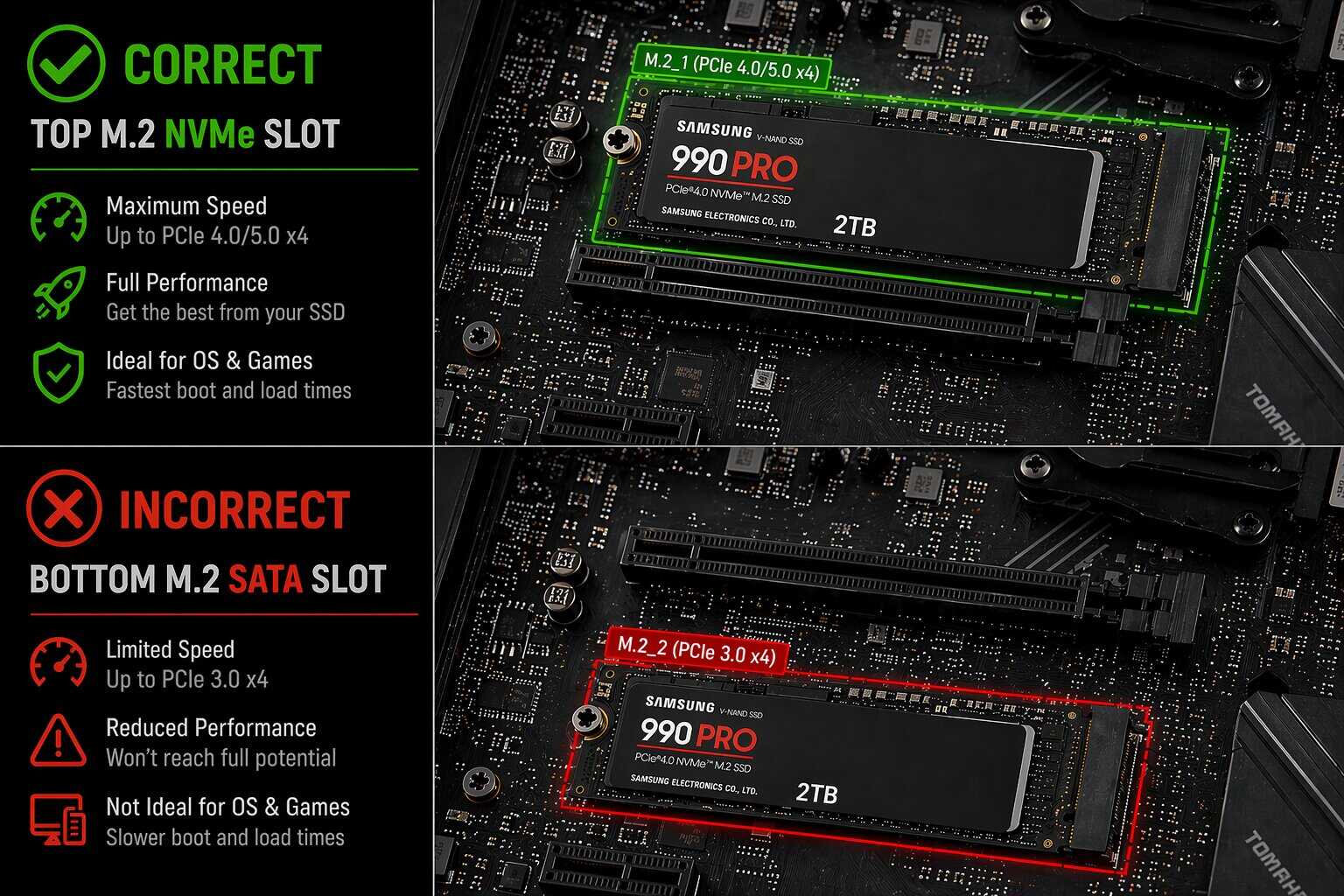

Donanım Etkisi: Yapay Zeka Kaynaklı DRAM Sıkışıklığını Hafifletme

Bu gelişimin önemi, KV önbelleği ayak izindeki agresif bir azalmanın sadece soyut bir yazılım kilometre taşı olmamasından kaynaklanıyor; bunun gerçek bellek tedarik zinciri için büyük çıkarımları var. Mevcut durumda HBM'ye (Yüksek Bant Genişlikli Bellek) olan doymak bilmez talep nedeniyle bir DRAM süper döngüsüne kilitlenmiş bir sektörle karşı karşıyayız. Bu dinamik, doğrudan tüketiciye yönelik PC'leriniz için satın aldığınız DIMM'lere ve SSD'lere kadar yayılan bir "tedarik sıkışıklığı" yarattı. DeepSeek V4'teki gibi yazılım düzeyinde sıkıştırma teknikleri ve Google'ın TurboQuant'ı gibi paralel algoritma değişiklikleri, tüketici PC piyasasını baskılayan aşırı donanım baskısını nihayet hafifletmeye başlayabilir. Kısacası: model oluşturucular her gigabayt HBM başına daha fazla çıktı elde etmeye devam ederse, nihai yük yapay zekanın bellek iştahının maliyetini taşıyan tüketicinin sırtından kalkacaktır.

Derinliklere İniş: Çok Başlı Gizli Dikkat (MLA) Mekanizması

Bu kazanımların arkasındaki mekanizma, şirketin daha önceki modellerinde ilk kez tanıttığı DeepSeek'in Çok Başlı Gizli Dikkat (MLA) mimarisidir. Bu tasarım, en baştan bellek kısıtlamaları etrafında inşa edilmiştir. MLA, her token için tam anahtar ve değer tensörlerini depolamak yerine, onları hesaplama zamanında geri genişletilen paylaşılan düşük dereceli gizli bir temsile yansıtır. KV önbelleği ayak izinde ağır işi yapan, standart dikkat uygulamalarının talep ettiği tam bellek vergisini ödemeden modelin verimli çalışmasını sağlayan bu sıkıştır-sonra-genişlet yaklaşımıdır.