Nvidia'nın üretim maliyetlerinin yaklaşık %90'ı artık Asyalı tedarikçilere ait. Bir yıl öncesine kadar bu oran yaklaşık %65 seviyesindeydi. Bu artış, özellikle yapay zeka donanımlarının giderek daha fazla fiziksel ürün kategorisine yayılmasıyla birlikte daha da derinleşme potansiyeli taşıyor.

Nvidia'nın mevcut veri merkezi tedarik zinciri, Tayvan'daki TSMC'nin yonga üretimi, SK Hynix ve Samsung'un yüksek bant genişlikli bellek (HBM) çözümleri ve Foxconn ile Quanta gibi firmaların sunucu montaj işlerini kapsıyor. Ancak şirketin fiziksel yapay zeka donanımları, bu tedarik zincirlerine tamamen yeni ürün kategorilerini de dahil ederek Asya'ya olan bağımlılığını artırıyor.

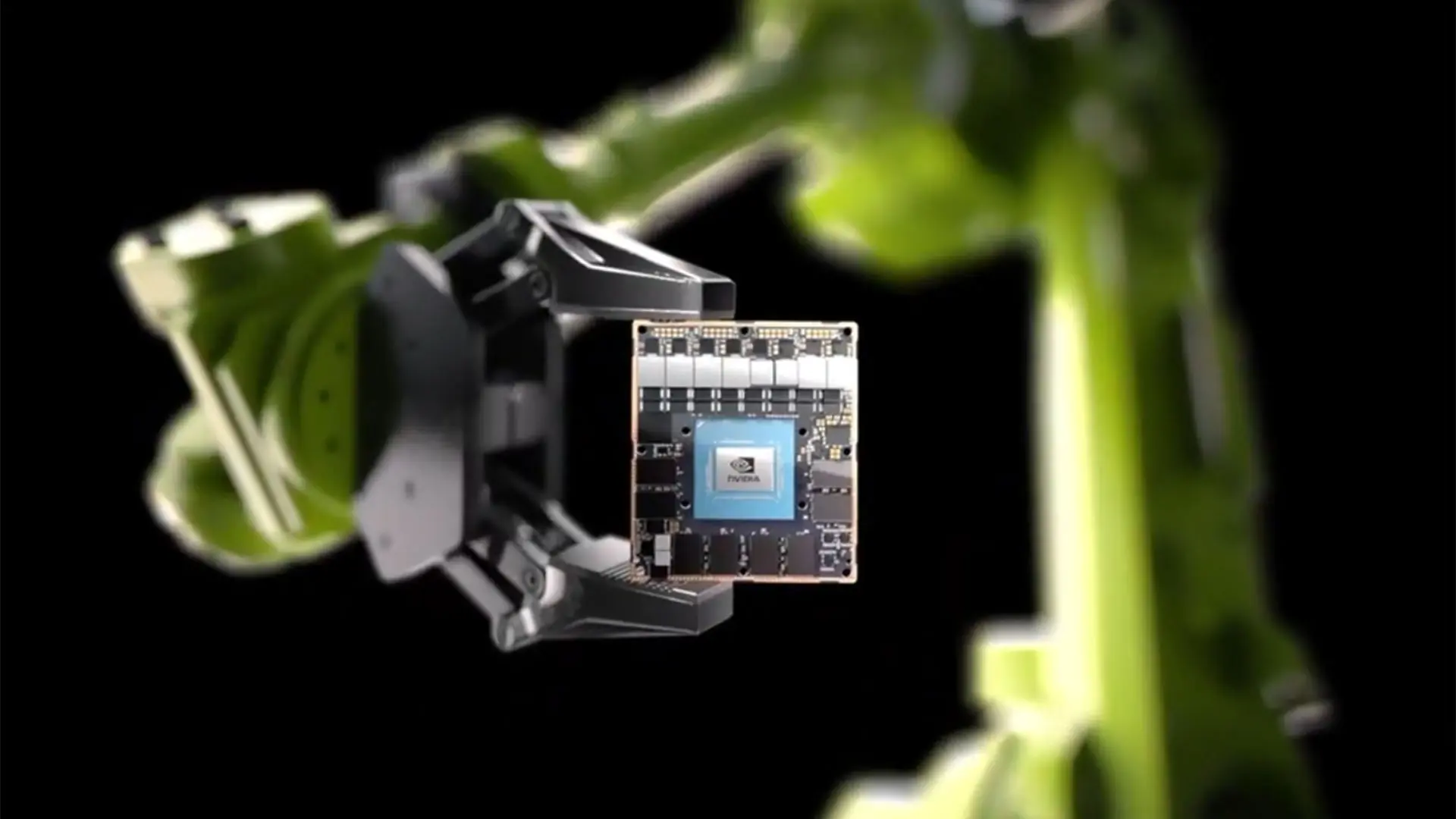

Geçtiğimiz Ağustos ayında tanıtılan Nvidia'nın Jetson Thor robotik platformu, Blackwell GPU mimarisi üzerine kurulu ve TSMC'nin 3nm süreciyle üretiliyor. En üst seviye T5000 modülü, 128 GB LPDDR5X bellek ile 2.070 FP4 TFLOPS işlem gücü sunarken, CES 2026'da duyurulan daha uygun fiyatlı T4000 varyantı ise 64 GB bellek ve 1.200 FP4 TFLOPS işlem gücü ile birim başına 1.999 dolardan sunuluyor. Her iki model de Arm Neoverse-V3AE CPU çekirdeklerini ve Samsung veya SK Hynix'ten tedarik edilen LPDDR5X bellekleri kullanıyor.

Bu modüller, Blackwell veri merkezi GPU'larıyla birlikte TSMC'nin 3nm üretim kapasitesi için yarışıyor. Boston Dynamics ve Amazon Robotics gibi iş ortakları bu platform üzerinde ürünler geliştirirken, LG'nin de Nvidia ile fiziksel yapay zeka, özellikle robotik ekosistemi alanında stratejik bir iş birliği yapmayı değerlendirdiği bildirildi. Nvidia'nın DRIVE AGX Thor otomotiv SoC'si de aynı 3nm üretim kapasitesini kullanan Blackwell tabanlı bir diğer ürün ailesi.

Bu fiziksel yapay zeka ürünlerinin hiçbiri, veri merkezi GPU üretiminde ana darboğaz olmaya devam eden TSMC'nin CoWoS gelişmiş paketlemesini gerektirmiyor. Ancak, halihazırda kısıtlı olan 3nm yonga üretim kapasitesini ve Asya'dan tedarik edilen LPDDR5X bellekleri tüketiyorlar.

Nvidia'nın yeni fiziksel yapay zeka ürünlerini besleyen aynı bellek piyasası dinamikleri, aynı zamanda eski ürünlerinin sonunu da getiriyor. Nisan ayı sonunda, LPDDR4 tedarikinin üretimini sürdürmek için fazla kısıtlı hale gelmesi nedeniyle Nvidia'nın Jetson TX2 ve Xavier modüllerinin kullanım ömrünü hızlandırdığı rapor edilmişti. Samsung'un LPDDR4 üretiminden uzaklaşması ve yapay zeka kaynaklı talebin bellek kapasitesini daha yüksek kar marjlı ürünlere yönlendirmesi bu durumu tetikledi.

Bu durum, Jetson müşterilerini Orin veya Thor modüllerine yöneltiyor. Bu modüller, zaten HBM ve veri merkezi DRAM talebiyle kapasitesi zorlanan aynı Asyalı bellek tedarikçilerinden LPDDR5X kullanıyor. TSMC'nin veri merkezi GPU'ları için sunduğu CoWoS gelişmiş paketleme teknolojisinin, TSMC'nin Kuzey Amerika paketleme bölümü başkanının geçen ay CNBC'ye yaptığı açıklamaya göre yıllık %80 bileşik büyüme oranıyla arttığı belirtiliyor. Ayrıca, TSMC'nin Arizona'daki Fab 21'de üretilen çiplerin hala paketleme için Tayvan'a geri gönderildiği bilgisi de dikkat çekiyor.

Nvidia, geçen yıl Foxconn ve Wistron ile ABD'de 500 milyar dolarlık sunucu üretimi taahhüdünde bulunmuştu. Amkor ve SPIL gibi firmalar da Arizona'da gelişmiş paketleme tesisleri inşa ediyor. Ancak bu operasyonlar henüz üretim ölçeğine ulaşmış değil ve fiziksel yapay zeka ürün serileri, yerel kapasitenin absorbe edebileceğinden daha hızlı bir şekilde Asya'dan tedarik edilen bileşenlerin çeşitliliğini artırıyor.