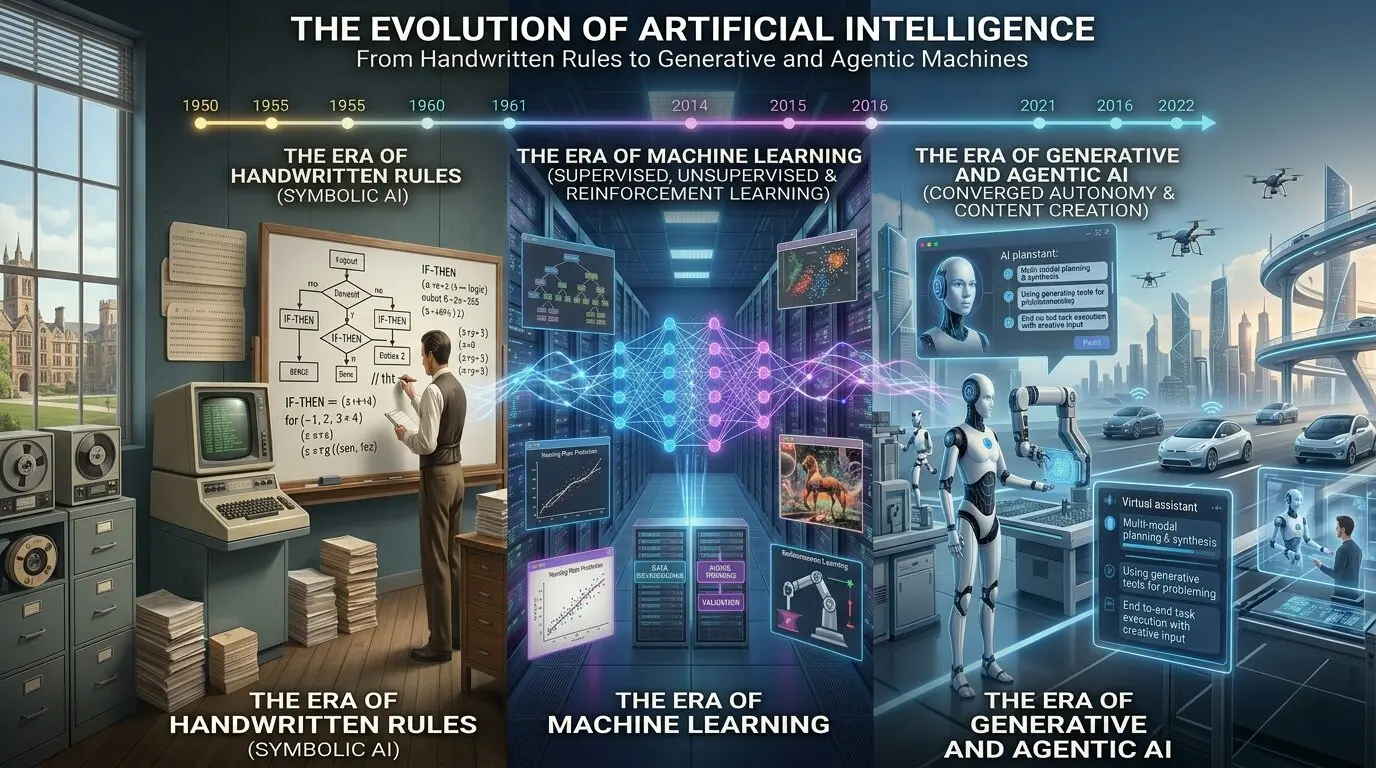

Yapay zeka (YZ), teknoloji dünyasında belki de en çok kullanılan terimlerden biri. Ancak sosyal medyadaki popüler söylemin aksine, bu alanın gerçek tarihi çok daha ilginç. YZ, tek bir icat değil ve ChatGPT'nin piyasaya sürülmesiyle aniden ortaya çıkmış da değil. Onlarca yıllık yoğun bir çalışmanın, büyük atılımların, çıkmazların ve tamamen yeniden yapılanmaların bir sonucu. Mantık kullanarak "düşünen" makinelerden, ham verilerden öğrenen istatistiksel modellere ve nihayetinde bugün gördüğümüz yapay sinir ağları (ANN) ve etkili sistemlere doğru evrildiğini izledik.

Temelde YZ'nin hikayesi, iki fikir arasındaki bir çekişmedir: açık sembolik yapıya karşı öğrenilmiş istatistiksel örüntüler. Bu yolculuğu büyüleyici kılan şey, yeni dönemlerin eskilerini sadece değiştirmemesi; onlara dayanarak, bir makinenin dünyayı nasıl temsil etmesi gerektiği veya belirsizlikte nasıl akıl yürütmesi gerektiği gibi temel sorular etrafında dönmesidir. Ayrıca, "zekanın" sadece akıllı kodlardan ibaret olmadığını öğreniyoruz. Bu, aynı zamanda ona uygulayabileceğimiz muazzam işlem gücü ve veri ölçeği ile de ilgilidir. Kısacası, YZ düz bir çizgide evrimleşmedi; dalgalar halinde ilerledi.

Yapay Zeka Adını Almadan Önce

Yapay zekanın resmi bir çalışma alanı olmasından çok uzun zaman önce, bilim insanları insan düşüncesini mekanize etme fikrine takıntılıydı. 1950'de Alan Turing, "Makinalar düşünebilir mi?" gibi soyut bir sorudan, davranışın daha pratik bir testi olan ve bugün Turing Testi olarak bildiğimiz şeye odaklanan dönüm noktası niteliğindeki makalesini yayınladı. 1950'lerin ortalarına gelindiğinde, araştırmacılar zekayı bellek, arama ve karar verme gibi parçalara ayrılabilecek bir mühendislik bulmacası olarak görmeye başladılar. Tüm bunlar, YZ'nin akademik bir disiplin olarak resmi doğuşu olarak kabul edilen Dartmouth çalıştayında zirveye ulaştı. O dönemdeki iyimserlik tavan yapmıştı; araştırmacılar gerçekten de tek bir nesil içinde insan düzeyinde zekayı çözeceklerine inanıyorlardı. Tarih farklı planlar yapmış olsa da, Dartmouth sahneyi hazırladı: YZ, bilgisayarlar aracılığıyla insan zekasını simüle etmeye yönelik ciddi bir çaba olacaktı.

Klasik YZ: Zeka Mantık, Kurallar ve Arama Olarak

Klasik YZ veya sembolik YZ olarak bilinen ilk büyük dönem, güzelce basit bir fikir üzerine kurulmuştu: zeka kuralları takip etmekten gelir. Mantık şuydu ki, insanlar gerçekler ve adımlar kullanarak akıl yürütüyorsa, makineler de aynısını yapmalıydı. Bu, bir sorunun aşılması gereken bir durum uzayı olarak görüldüğü "arama" ve "planlama" etrafında tasarlanmış sistemlere yol açtı. Bu dünya görüşünde zeka, temelde bir hedefe en verimli yolu bulma yeteneğiydi. Dijkstra'nın algoritması gibi bu erken yöntemlerin birçoğu, robotikten oyun yol bulmaya kadar her şeyi bugün hala destekleyen modern bilgisayar bilimlerinin omurgasını oluşturmaya devam ediyor.

Sembolik YZ çalıştığında zarif ve anlaşılması kolaydı. Makineler kolayca matematiksel teoremleri kanıtlayabilir veya yapılandırılmış oyunlar oynayabilirdi. Ancak bir zorluk vardı: bu, yalnızca dünya mükemmel bir şekilde biçimlendirilmiş terimlerle tanımlanabiliyorsa işe yarıyordu. Ne yazık ki gerçek hayat karmaşık, belirsiz ve istisnalarla doludur. Sembolik sistemler kontrollü ortamlarda harikaydı, ancak öngörülemeyen gerçek dünya ile temas ettikleri anda inanılmaz derecede kırılgan hale geldiler. Bu sınırlama, maalesef YZ alanını yıllarca rahatsız edecekti.

Uzman Sistemler ve İlk Ticari Yapay Zeka Patlaması

Sembolik YZ'nin en ünlü yan ürünlerinden biri uzman sistemlerdi. Bunlar, uzman bilgisini büyük bir "eğer-o zaman" kuralı listesine hapsetmek için tasarlandı. Bir süre için, bu sistemlerin tıp ve işletmeleri taklit ederek devrim yaratacağı düşünülüyordu. YZ'nin ilk kez gerçekten uygulanabilir bir ticari ürün gibi hissettirdiği zamanlardan biriydi.

Ne yazık ki, bu sistemler bilgi edinme darboğazı olarak bilinen bir duvara çarptı. Bir insan uzmandan her tekil kuralı kodlamak yorucu, pahalı ve alanlar değiştikçe güncel tutmak neredeyse imkansızdı. Sonuçlar büyük abartılara ulaşmadığında, bu durum birkaç "YZ kışından" ilkini tetikledi. Bunlar, beklentilerin gerçekliği aştığı için fonlama ve ilginin kuruduğu dönemlerdi.

İstatistiksel Dönüş: Makine Öğrenmesi Soruyu Değiştiriyor

Sonunda, alan "Bir makineye zekanın nasıl göründüğünü nasıl söyleriz?" diye sormayı bıraktı ve "Ya makinenin verideki örüntüleri kendisinin bulmasına izin verirsek ne olur?" diye sormaya başladı. Bu, makine öğrenmesinin (veya ML) doğuşuydu ve tamamen bir oyun değiştiriciydi. Her kuralı el yazısıyla yazmak yerine, araştırmacılar zekayı genelleme problemi olarak ele aldılar: bir sisteme yeterince örnek verin ve yeni veriler üzerinde iyi performans göstermesi için kendisini optimize etmesine izin verin.

Bu dönem bize karar ağaçları, destek vektör makineleri (SVM'ler) ve topluluk yöntemleri gibi pratik araçları getirdi. "Düşünen makineler" kadar gösterişli değillerdi, ancak dolandırıcılık tespiti ve arama sonuçlarını sıralama gibi gerçek dünya görevlerinde inanılmaz derecede etkiliydiler. Makine öğrenmesi mütevazı olduğu için başarılı oldu; sentetik bir insan zihnini vaat etmiyordu, sadece gördüğü veri arttıkça daha iyi hale gelen bir sistem vaat ediyordu.

Yapay Sinir Ağları: Zamanını Beklemek Zorunda Kalan Eski Bir Fikir

Modern bir atılım gibi hissettirse de, yapay sinir ağları aslında kitaplardaki en eski fikirlerden biridir. Hesaplamalı "nöronlar" konsepti 1940'lara dayanıyor ve perceptron 1950'lerde büyük ilgi gördü. Hayal, bir sistemin bilgiyi temsil etme yolunu kendi başına keşfetmek için kendi ağırlıklarını ayarlamasına izin vermesiydi.

Ancak, erken sürümler takılıp kaldı. Gerçekten parlamaları için gerekli işlem gücüne veya bol miktarda veriye sahip değillerdi ve derin mimarileri eğitmek bir kabustu. Geri yayılım (backpropagation) ve gradyan inişi ile işler değişmeye başladı, bu da nihayet çok katmanlı ağları eğitme imkanı sağladı. O zaman bile, dünya henüz onlara tam olarak hazır değildi. YZ tarihinde tekrarlayan bir tema var: harika bir fikir genellikle onu kullanmak için donanıma sahip olmamızdan on yıllar önce gelir.

Derin Öğrenme: Veri, Algoritmalar ve Donanım Sonunda Birleştiğinde

Derin öğrenme aslında yeni bir YZ "türü" değil. Sadece sinir ağları yeterince büyüdüğünde ve karmaşık hiyerarşileri kendi başlarına öğrenecek kadar veri açlığı çektiğinde olan şeydir. Sığ bir model, bir insanın "burun"un nasıl göründüğünü açıklaması gerekebilir, ancak derin bir model kenarları, sonra şekilleri, sonra tam nesneleri tamamen kendi başına tanımayı öğrenebilir.

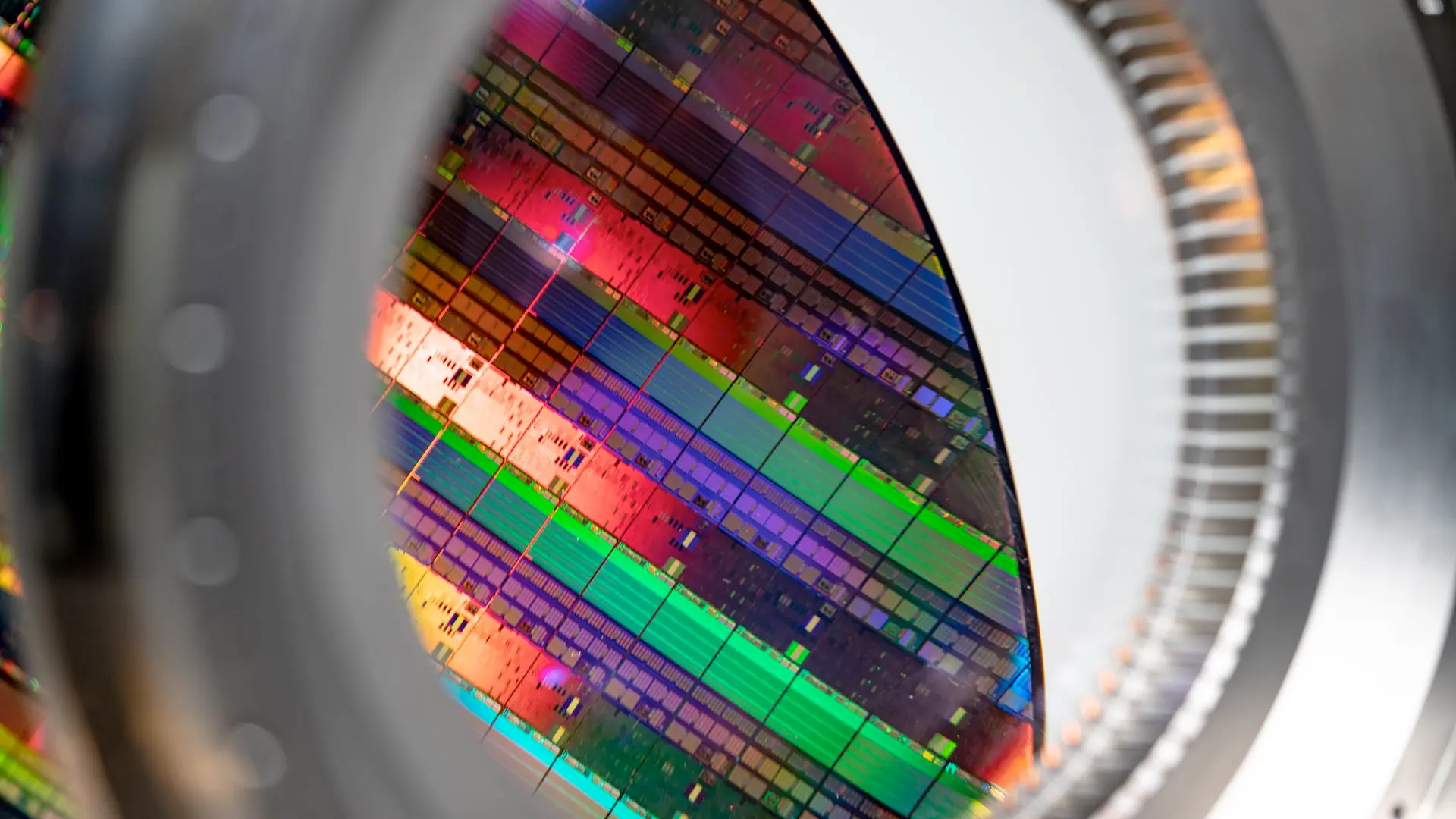

Büyük "Aha!" anı 2012'de, ImageNet karşılaştırmasında büyük başarı gösteren bir evrişimli sinir ağı (CNN) olan AlexNet ile geldi. Bu, devasa veri kümelerini Grafik İşlem Birimlerinin (GPU) ham gücüyle birleştirirseniz, yıllardır durgun olan bilgisayarlı görü gibi sorunları çözebileceğinizi kanıtladı. Bu önemli bir nokta: YZ'nin evrimi sadece bir yazılım hikayesi değil; aynı zamanda bir donanım hikayesi. Aslen oyun için tasarlanmış GPU'lar, YZ/ML dünyasında "matmul" (matris çarpımı) ve derin sinir ağlarının (DNN) gerektirdiği lineer cebir için mükemmel olduklarını kanıtladılar. Daha sonra, Tensor Çekirdekleri gibi özel donanım birimleri ve tensör işlem birimleri (TPU) gibi özel YZ hızlandırıcıları işleri daha da ileri götürdü. Bu donanım kayması olmadan, derin öğrenme hala niş bir akademik ilgi alanı olurdu.

Pekiştirme Öğrenmesi: Ödül Yoluyla Makinelere Öğretmek

YZ'nin çoğu etiketlerden öğrenirken, pekiştirmeli öğrenme (RL) olarak adlandırılan başka bir dal, deneme yanılma yoluyla öğreniyordu. Bir köpeği eğitmek gibi düşünün: "ajan" bir ortamda bir eylem gerçekleştirir ve eylemleri için bir ödül veya ceza alır. Bu basit döngü, YZ'deki en etkileyici başarıların bazılarına yol açtı, en önemlisi AlphaGo. Sinir ağlarını arama ile birleştirerek, AlphaGo makinelerin bilgisayarların "anlayamayacağı" düşünülen oyunlarda ustalaşabileceğini gösterdi. Bu aynı zamanda eski usul sembolik yöntemlerin ölmediğini de kanıtladı; sadece modern öğrenme ile birleştirilmişlerdi. Bugün RL, robotik, kontrol sistemleri, optimizasyon ve nihayetinde dil modelleri için hizalama tekniklerinin merkezindedir.

Transformer Çağı: Yapay Zeka Sıralı Düşünmeyi Bırakıyor

Bir sonraki büyük sıçrama Transformer oldu. Bundan önce, doğal dil işleme (NLP), metni kelime kelime işlemek zorunda kalan tekrarlayan sinir ağlarına (RNN'ler) dayanıyordu, bu da büyük bir performans darboğazı yaratıyordu. Transformer'lar bunu dikkat mekanizmaları lehine terk etti, bu da modelin bir cümledeki her kelimeye (token olarak da adlandırılır) aynı anda bakmasına olanak tanıdı.

2017'deki Attention Is All You Need makalesi, modern büyük dil modeli (LLM) devrimini başlattı. Bu mimari güzel bir şekilde ölçeklendi, bu da onu modern veri merkezlerinde gerçekleşen devasa eğitimler için mükemmel hale getirdi. Bugün gördüğümüz neredeyse her şey - LLM'lerden çok modlu sistemlere ve görüntü üretimi araçlarına kadar - bu devrimden izlenebilir.

Üretken Yapay Zeka: Tahmin Motorlarından İçerik Üretme Makinelerine

Üretken Yapay Zeka, günümüzde neredeyse herkesin konuştuğu şeydir, ancak aslında makine/derin öğrenme alanındaki çeşitli disiplinlerin bir karışımıdır. Bunlar arasında olasılıksal modelleme, yapay sıra modellemesi, gizli değişkenli modeller, düşmanca eğitim, yayılma süreçleri ve büyük ölçekli ön eğitim yer alır. Temelinde, bir makinenin gerçekmiş gibi görünen yeni içerikler oluşturabilecek kadar iyi veri modellemeyle ilgilidir.

Büyük dil modelleri bunun en görünür kısmıdır. Dev metinler üzerinde bir sonraki kelimeyi/token'ı tahmin etmeyi öğrenerek, özetleme, kodlama ve çevirme konusunda akıl almaz bir yetenek geliştirdiler. OpenAI'nin GPT-3'ü, bu modelleri büyütmeye devam ederseniz, özel olarak eğitilmedikleri şeyleri "öğrenmeye" başladıklarını gösterdiği için büyük bir kilometre taşıydı. Görsel tarafta, Stable Diffusion gibi yayılma modelleri, gürültü sürecini tersine çevirerek çarpıcı derecede ayrıntılı görüntüler oluşturmayı öğrenerek oyunu değiştirdi. Ancak gerçek sihir, arayüzün değişmesidir: doğal dil, bizim için "kodlama" veya bilgisayarlarla etkileşim kurmanın yeni yolu haline geldi, en azından çoğumuz için!

Etkili Yapay Zeka: Üretimden Sonraki Adım

Üretken YZ içerik üretmekle ilgiliyse, etkili YZ bir şeyler yapmakla ilgilidir.

Üretken YZ bir şeyler üretmekle ilgiliyse, etkili YZ bir şeyler yapmakla ilgilidir. Bu sistemler tek bir istemden sonra durmaz; bellek, araçlar ve planlama döngüleri kullanarak karmaşık görevleri çözerler. Bir hedefi adımlara ayırabilir, web'den bilgi alabilir ve ilerledikçe planlarını revize edebilirler. ReAct gibi araştırmalar, bu "düşün-sonra-hareket et" döngüsünü resmileştirmeye yardımcı oldu.

Ve hikayenin gerçekten ilginçleştiği yer burası: etkili YZ, alanın en eski hayallerinden bazılarına biraz geri dönüştür. Klasik/sembolik YZ her zaman planlama ve hedef odaklılık ile ilgiliydi; şimdi fark, katı kurallar yerine "beyin" olarak yüz milyarlarca parametreye sahip dev LLM'leri kullanıyor olmamız. Yazılım sistemlarının, sinir ağlarının ham örüntü tanıma gücünü sembolik araçların hassasiyeti ve belleğiyle birleştirdiği hibritler çağındayız.

Yapay Zekanın Hala Yüz Verdiği Zorluklar

Tüm bu ilerlemeye rağmen, YZ hala geçmişinden gelen şeytanlarla boğuşuyor. Sembolik sistemler kırılgan olsalar da, modern derin modeller genellikle opak "kara kutular"dır. Üretken sistemler halüsinasyon görebilir ve etkili sistemler küçük hataları çok daha büyük başarısızlıklara dönüştürebilir. Bu tam da bu yüzden Amerikan Ulusal Standartlar ve Teknoloji Enstitüsü'nün (NIST) Yapay Zeka Risk Yönetimi Çerçevesi gibi güvenlik çerçeveleri ve Avrupa Birliği Yapay Zeka Yasası gibi düzenlemeler (Avrupa Komisyonu'nun 1 Ağustos 2024'te resmi olarak başladığını belirttiği) artık YZ'nin teknik manzarasının bir parçası haline gelmiştir.

Yapay Zeka Gelecekte Nereye Gidebilir?

Peki, sırada ne var? Muhtemelen tek bir atılım değil, devasa bir yakınsama olacak. Daha çok modlu, araçlara daha duyarlı, daha kalıcı ve daha büyük yazılım döngülerine gömülü sistemlere doğru ilerliyoruz. Gelecekteki ajanlar sadece sohbet etmeyecek; uzun zaman dilimlerinde çalışacak ve oldukça karmaşık iş akışlarını koordine edeceklerdir.

Tek başına ölçek artık cevap olmayabilir, çünkü artık verimlilik, temellendirme ve güvenilirliğe odaklanıyoruz. Daha büyük modeller bizi buraya getirdi, ancak daha iyi sistem mühendisliği bir sonraki adımı belirleyecek. Gelecek muhtemelen yukarıda bahsedilen hibritlere ait olacak; bunlar sinir ağlarının ham örüntü tanıma gücünü sembolik araçların hassasiyeti ve belleğiyle birleştiren yazılım sistemleridir. İronik bir şekilde, YZ'nin geleceği geçmişinin bir yeniden birleşmesi gibi görünüyor.

Son Sözler

YZ'nin hikayesi aslında "zekanın" ne anlama geldiğini sürekli yeniden tanımlayan bir alanın hikayesidir. Mantık olarak başladı, istatistik oldu, sonra temsil öğrenimi oldu ve şimdi üretebilen, erişebilen, akıl yürütebilen ve hareket edebilen sistemler gibi görünüyor. Her yeni dal bir sorunu çözdü ama bir başkasını yarattı. Bu evrim, bugünkü patlamanın sihir değil, uzun bir teknik yaydaki en son bölüm olduğunu hatırlattığı için kavramamız önemlidir. Tarihin bize bir şey öğrettiği varsa, o da bir sonraki büyük sıçramanın geçmişi atmaktan değil, onu nasıl yeniden birleştireceğimizi bulmaktan geleceği olmuştur.