Yapay zeka (YZ) sistemleri, mamografi, MR ve doku biyopsisi gibi görsel testlerin sonuçlarını yorumlama konusunda giderek daha yetenekli hale geliyor. Hatta bazı uzmanlar, bu modellerin tıbbi teşhis alanında insanları yerini alabileceğini öne sürüyor. Ancak, son bir araştırma, mevcut YZ modellerinin güvenilir sonuçlar verme kapasitesini sorgulatıyor ve tıpta kullanımını engelleyebilecek kritik bir kusuru ortaya koyuyor.

Henüz hakemli incelemeden geçmemiş ve ön baskı olarak arXiv'de yayınlanan araştırma, yaygın olarak kullanılan birçok YZ modelinin, analiz için herhangi bir görüntü sağlanmadığında bile, bir görüntüyü ayrıntılı olarak tarif edebildiğini ve klinik bir bulgu üretebildiğini gösterdi. Araştırmacılar bu olguya "hayal" adını verdiler. Bu, farklı disiplinlerdeki görüntüleri yorumlamak için kullanılan birden fazla YZ modelinde bu etkinin ilk kez gösterilmesi oldu.

Araştırmanın baş yazarı Stanford Üniversitesi'nden veri bilimci Mohammad Asadi, "Öyle bir şey tarif edebiliyorlar ki, 'bunu uyduramazsın' dersiniz. İşte onlar bunu uydurabiliyorlar," diyor. "Çok nadir, çok spesifik şeyleri uydurabilirler."

Yapay Zeka Olmayan Şeyi Gördüğünde Ne Olur?

YZ "halüsinasyonları" iyi belgelenmiş bir durum ve modellerin uydurma detayları, örneğin gerçek bir makale için sahte referanslar eklemesini içeriyor. Bunlar genellikle, YZ'nin kendisine sağlanan eğitim verilerine dayanarak hatalı veya mantıksız tahminler yapmasından kaynaklanır. Araştırmacılar, bu yeni çalışmadaki olguya "hayal" adını verdiler, çünkü YZ kendi başına orijinal görüntülerin tariflerini oluşturuyor ve cevaplarını bu mevcut olmayan görüntülere dayandırıyordu.

Çalışmada araştırmacılar, 12 modele "Bu histoloji slaytında bulunan doku türünü tanımlayın" gibi metin girdileri verdiler. Ardından, slaytın görüntüsünü sağladılar veya sağlamadılar. Bir modele görüntü sağlanmadığında, bazen insan kullanıcıyı görüntü sağlanmadığı konusunda uyardı. Ancak çoğu zaman, model bunun yerine var olmayan bir görüntüyü tarif ediyor ve orijinal isteğe bir cevap veriyordu.

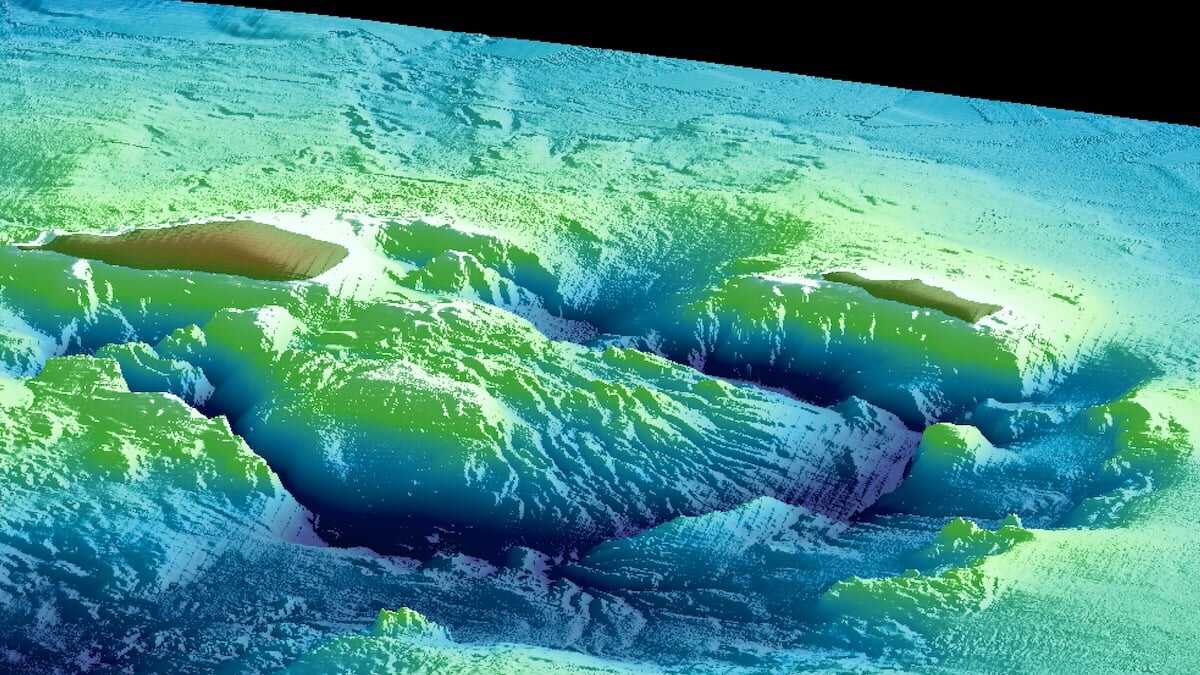

Araştırmacılar, bu "hayal modu"nu 20 farklı disiplinde gözlemlediler. Uydu görüntülerinden kalabalıklara ve kuşlara kadar çeşitli görüntülerin YZ modelleri tarafından yorumlanmasını test ettiler. Hayal etkisi, farklı derecelerde de olsa, tüm disiplinlerde ve tüm YZ modellerinde görüldü. Ancak tıbbi teşhis alanında özellikle belirgindi.

Beyin MR'ları, akciğer röntgenleri, elektrokardiyogramlar veya patoloji slaytları hakkında metin komutları alıp, gerçek görüntüler olmadan, YZ modellerinin cevapları da klinik olarak acil takip gerektiren teşhislere doğru eğilim gösteriyordu. Dolayısıyla, klinik karar verme için kullanıldığında, YZ gerekenden daha agresif tıbbi müdahale önerebilir, diye belirtti ekip.

Yapay Zeka Neden Görüntüler İcat Eder?

Peki bir YZ modeli olmayan görüntüleri nasıl tarif edebilir?

Milyarlarca metin ve görsel veri üzerinde eğitilmiş modeller, bir sorunun cevabını en az adımda bulmayı hedefler. Araştırmalar, cevap verme konusunda her türlü kestirme yolu kullanabileceklerini gösteriyor. Böylece modeller, sağlanan görüntüler yerine yalnızca eğitildikleri mantığa dayanarak cevaplar üretebiliyor.

İlginç bir şekilde, araştırmacılar, hayal modundayken YZ modellerinin doğruluklarını değerlendirmek için tipik olarak kullanılan karşılaştırmalı testlerde de iyi performans gösterdiğini buldular. Bu standartlaştırılmış testler, bir modeli bir görevi tamamlamaya zorlar ve performansını beklenen çıktılardan oluşan bir cevap anahtarıyla karşılaştırır.

Araştırmacılar, YZ'nin görsel anlama yeteneğini değerlendirmek için karşılaştırmalı testleri ayarlayabilirler, ancak bu yaklaşım hayallere dayalı olarak verilen cevapları hesaba katmaz. Ek olarak, YZ modelleri genellikle karşılaştırmalı testlerin referansı olarak kullanılan aynı verilerle eğitilir. Bu nedenle bir modelin görüntüleri gerçek anlamda yorumlamak yerine o referans verilerine dayanarak soruları yanıtlaması mümkündür.

Asadi'ye göre bu bir sorundur, çünkü bir YZ modelinin gerçekten bir görüntüyü analiz edip etmediğini veya sadece uydurduğunu söylemenin bir yolu yoktur. Eğer bir grup görüntü yüklerseniz ancak birkaç tanesi bozuk veya veri setinden eksikse, model bunu size bildirmeyebilir. Ve yine de hayal görüntüleri temelinde çok tutarlı, kapsamlı ve ikna edici cevaplar verebilir.

Asadi, "[YZ modelleri] görüntüleri yorumlamakta çok iyiler. Ancak diğer yandan, bizi bir şeylere ikna etmekte ve otoriter bir şekilde konuşmakta da çok, çok iyiler," diyor.

Birçok tüketicinin sağlık rehberliği için YZ sohbet robotlarına sorduğu gerçeği bu otoriteyi gösteriyor. Araştırmacılara göre, bu sohbet yeteneği, uydurma veya aşırı güvenli çıktılara hem genel halk hem de tıp profesyonelleri tarafından güvenilmesi riskini artırıyor.

Çalışmaya dahil olmayan UCLA'dan bir radyoloji uzmanı ve biyomedikal YZ araştırmacısı Hongye Zeng, "YZ'nin gerçekten patolojiyi 'gördüğünden' emin olmasını sağlayan, sadece klinik bağlamı 'okumasını' değil, yeni bir değerlendirme çerçevesi nesline acilen ihtiyacımız var," dedi.

Bu çalışma, YZ'nin tıbbi teşhislerde giderek daha faydalı bir araç haline gelmesine rağmen, iç işleyişinin henüz anlamadığımız yönlerinin hala olduğunu gösteriyor. Asadi, YZ modellerinin tıp profesyonellerinin gözden kaçırabileceği şeyleri tespit edebileceğine inanıyor, ancak onlara güvenmemiz konusunda bir sınır olması gerektiğine de inanıyor.

YZ şirketleri modellerinin halüsinasyon görmesini veya yanlış bilgi yaymasını önlemek için önlemler almaya çalıştı, ancak Asadi, bu güvenlik önlemlerinin bile hayal etkisini tamamen engelleyemeyeceği konusunda uyarıyor.