Yapay zeka alanında öncü firmalardan Anthropic, üç büyük Çinli yapay zeka geliştiricisini, modellerini geliştirmek için Anthropic'in Claude yeteneklerini 'endüstriyel ölçekte' kopyalamakla suçladı. DeepSeek, Moonshot ve MiniMax adlı şirketlerin, toplamda 24 bin sahte hesap ve 16 milyon etkileşim kullanarak bu yönteme başvurduğu iddia ediliyor.

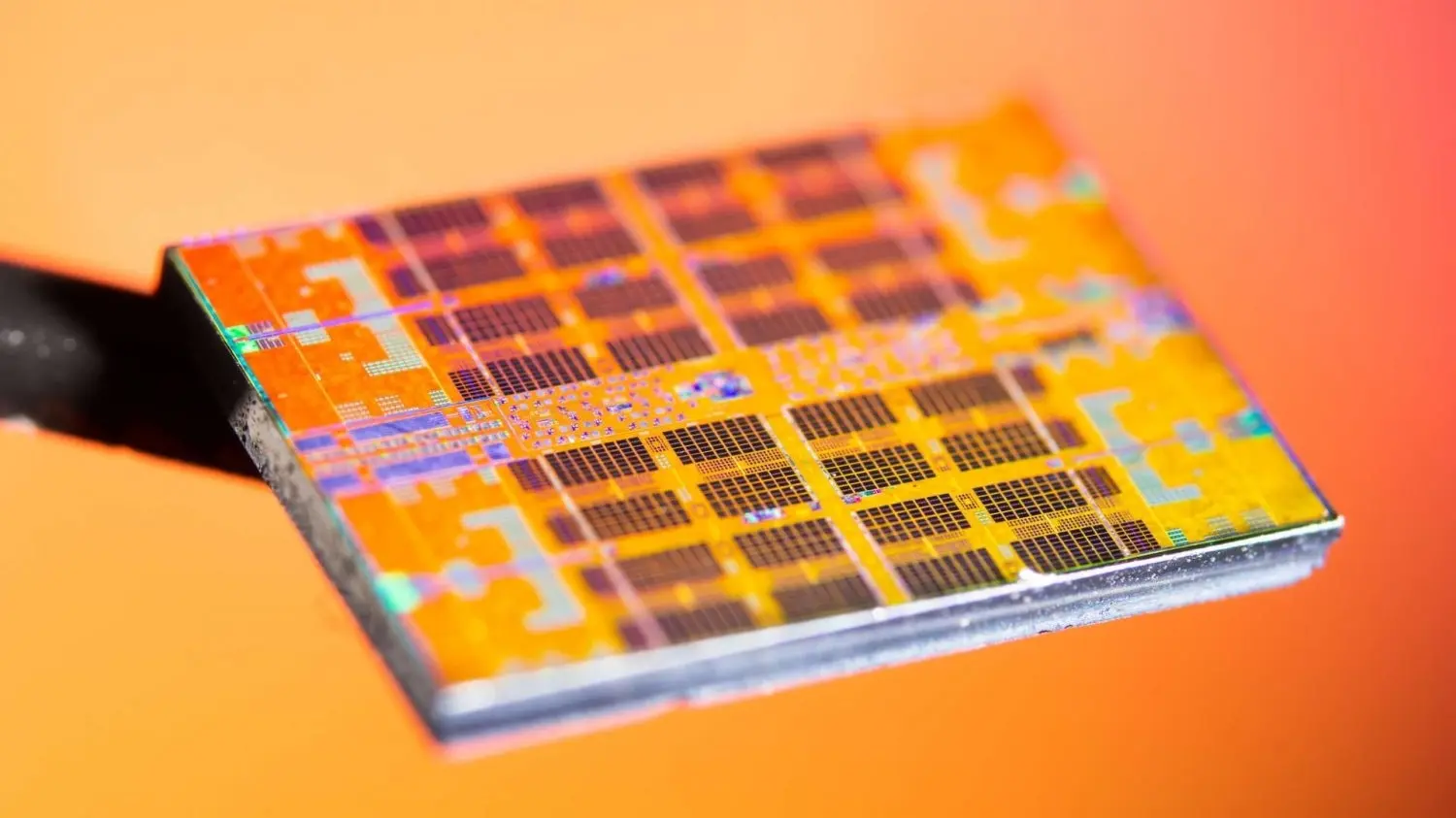

Yapay Zeka Eğitiminde Hassas Bir Teknik: Distilasyon (Damıtma)

Distilasyon, makine öğrenmesinde kullanılan bir tekniktir. Bu yöntemde, daha güçlü bir modelin çıktıları kullanılarak daha küçük veya daha az yetenekli bir model eğitilir. Gerçek veriler yerine, güçlü modelin ürettikleri kullanıldığı için bu işlem zaman kazandırabilir, daha ucuz ve özelleşmiş modeller oluşturmayı sağlayabilir. Hatta rakiplerin yeteneklerini kopyalamak veya daha az donanım gereksinimiyle modelleri çalıştırmak mümkün olabilir.

Distilasyon genel olarak meşru bir teknik olsa da, ABD'nin ihracat kısıtlamaları ve lisans anlaşmalarına tabi olan şirketlerin bu yöntemi etik olmayan yollarla kullanması ciddi sonuçlar doğurabiliyor. Anthropic'ten yapılan açıklamada, bu tür bir damıtmanın ABD'nin ihracat kontrollerini ve kendi lisans anlaşmalarını ihlal ettiği belirtiliyor.

Anthropic, bu durumun sadece rekabetçi avantaj elde etmekle kalmayıp, aynı zamanda yabancı yapay zeka laboratuvarlarının güvenlik önlemlerini kaldırarak kendi askeri, istihbarat ve gözetim sistemlerine yetenek aktarmasına olanak tanıyabileceği konusunda uyarıyor.

Çinli Şirketlerin Yöntemi Ortaya Çıktı

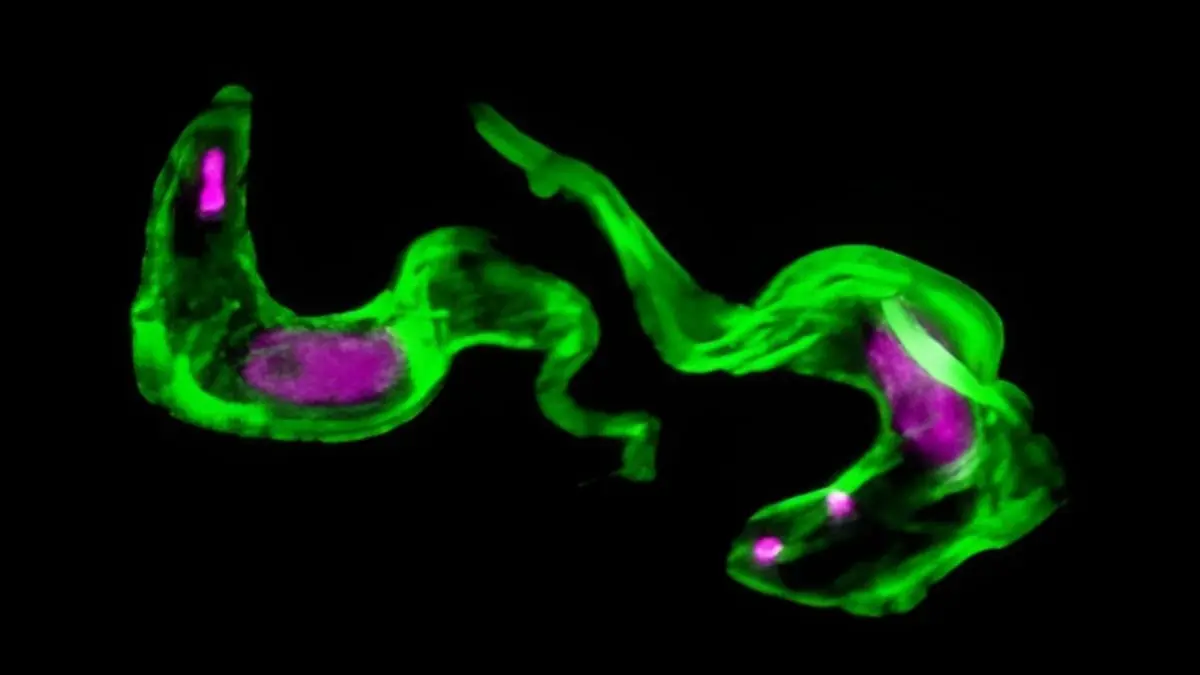

Anthropic'e göre, suçlanan şirketler benzer bir yolu izlemiş. Sınır ötesi yapay zeka modellerine erişim sağlayan ticari hizmetleri kullanarak, şirketin 'hidra kümesi' adını verdiği ağlar kurmuşlar. Bu ağlar, Anthropic'in API'si ve üçüncü taraf bulut hizmetleri üzerinden trafiği dağıtan büyük hesap havuzlarından oluşuyor.

İddialara göre, tek bir proxy kurulumu 20 binden fazla sahte hesabı aynı anda kontrol etmiş. Tespit edilmemek için bu çıkarım trafiğini sıradan kullanım istekleriyle karıştırmışlar. Ancak, çok yüksek hacimli, belirli yeteneklere odaklanmış ve son derece tekrarlayan istem kalıpları bu durumu ele vermiş. Bu tür davranışlar model eğitimiyle tutarlı olsa da, tipik bir son kullanıcı etkileşiminden uzak.

Anthropic, özellikle DeepSeek'in muhakeme görevlerine yönelik 150 binden fazla etkileşim gerçekleştirdiğini, bunun yanı sıra pekiştirmeli öğrenme ödül modelleri için uygun puanlama ve politik olarak hassas sorguların sansürden arındırılmış yeniden yazımları gibi alanlarda da çalıştığını belirtiyor. Ayrıca, adım adım iç muhakemeyi ortaya çıkarmak ve zincirleme düşünce eğitim verilerini ifşa etmek amacıyla tasarlanmış istemler de tespit edilmiş.

Moonshot ve MiniMax'in Rolü

Kimi modelleriyle tanınan Moonshot'un 3.4 milyondan fazla etkileşime karıştığı öne sürülüyor. Şirketin odak alanları arasında ajan muhakemesi, araç kullanımı, kodlama, veri analizi, bilgisayar kullanımı ajanları ve bilgisayar görüşü yer alıyor. Moonshot'un yüzlerce sahte hesap kullanarak Claude'un muhakeme izlerini çıkarmaya ve yeniden yapılandırmaya çalıştığı iddia ediliyor.

MiniMax ise en büyük kampanyayı, 13 milyondan fazla etkileşimle ajan kodlama ve orkestrasyonu hedefleyerek yürütmüş. Anthropic, bu operasyonu MiniMax'in gelecekte piyasaya süreceği bir modeli eğittiği sırada tespit ettiğini ve böylece çıkarım döngüsünün erken aşamalarına dair benzersiz bir bakış açısı elde ettiğini belirtiyor. Hatta Anthropic yeni bir Claude modeli tanıttıktan sonra MiniMax'in trafiğinin neredeyse yarısını 24 saat içinde yönlendirerek en son modelin yeteneklerini yakalamaya çalıştığı iddia ediliyor.

Anthropic'in Karşı Önlemleri

Anthropic, gelecekteki distilasyon girişimleriyle mücadele etmek için savunmalarını güçlendirdiğini belirtiyor. Büyük ölçekli damıtmayı daha zor ve daha kolay tespit edilebilir hale getirmeyi hedefliyorlar. Şirket, zincirleme düşünce istemlerini ve koordineli çoklu hesap etkinliklerini içeren çıkarım kalıplarını belirlemek için sınıflandırıcılar ve davranışsal parmak izi sistemleri devreye sokmuş.

Ayrıca, büyük ölçekli distilasyon operasyonlarının teknik göstergelerini diğer yapay zeka laboratuvarları, bulut sağlayıcıları ve yetkililerle paylaşıyorlar. Eğitim, araştırma ve startup hesapları için doğrulamaları sıkılaştırarak sahte erişimin önüne geçmeyi amaçlıyorlar. Bununla birlikte, meşru kullanıcıları olumsuz etkilemeden yasa dışı eğitim için çıktıların faydasını azaltacak ürün, API ve model düzeyinde korumalar geliştiriyorlar. Anthropic, bu ölçekteki saldırıları engellemek için sektör ve politika düzeyinde koordineli eylemlerin gerekliliğini vurguluyor.