Oyun dünyasında görüntü kalitesi, her zaman oyuncular için kritik bir öneme sahip olmuştur. Özellikle günümüz oyunlarında kullanılan DLSS gibi yükseltme teknolojileri, kare oluşturma teknikleri ve daha fazlası, görüntüde birtakım bozulmalara yol açabiliyor. Bu bozulmalar arasında hayaletlenme (ghosting), titreme (flicker), kenar tırtıklanması (aliasing), ayrışma (disocclusion) gibi pek çok sorun yer alıyor. Bu sorunları daha önce daha çok öznel yorumlarla dile getiriyorduk; ancak artık bu teknolojilerin çıktı kalitesini objektif olarak ölçmek için güçlü bir araç mevcut.

Intel, oyunlarda görüntü kalitesini daha objektif bir şekilde değerlendirmeyi kolaylaştıracak yeni bir yapay zeka tabanlı araç geliştirdi. Bilgisayar Grafikleri Görsel Kalite Metriği (Computer Graphics Visual Quality Metric - CGVQM) adını taşıyan bu araç, artık GitHub üzerinde bir PyTorch uygulaması olarak kullanıma sunuldu.

Görüntü kalitesini ölçmek için genel olarak kullanılan Sinyal-Gürültü Oranı Tepe Değeri (PSNR) gibi metriklerin, gerçek zamanlı grafik çıktılarının değerlendirilmesinde yetersiz kaldığı biliniyor. PSNR, genellikle kayıplı sıkıştırmanın kalitesini ölçmek için tasarlanmıştır ve gerçek zamanlı grafiklerde yaygın olmayan sıkıştırma artefaktlarını göz ardı edebilir.

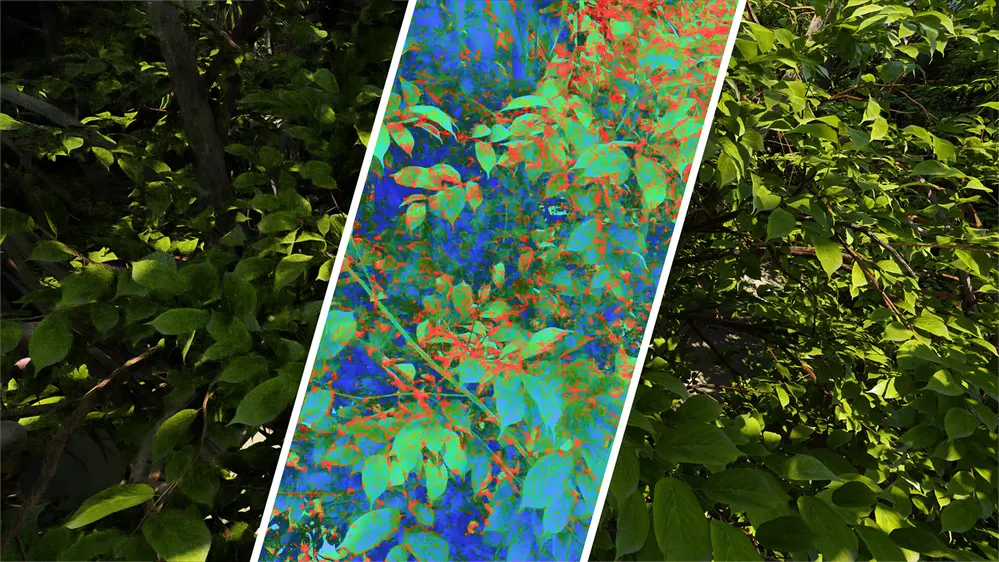

Intel araştırmacıları, bu sorunu çözmek için iki aşamalı bir yaklaşım benimsedi. İlk olarak, modern işleme tekniklerinden kaynaklanan çeşitli görüntü kalitesi bozulmalarını içeren yeni bir veri seti olan Bilgisayar Grafikleri Görsel Kalite Veri Seti (CGVQD) oluşturuldu. Bu veri setinde path tracing, sinirsel gürültü azaltma, sinirsel süper örnekleme teknikleri (FSR, XeSS, DLSS gibi), Gaussian splatting, kare interpolasyonu ve adaptif değişken oranlı gölgeleme gibi çeşitli kaynaklardan elde edilen bozulmalar yer alıyor.

İkinci olarak, araştırmacılar bu bozulmaları dikkate alarak yeni bir görüntü kalitesi derecelendirmesi üreten bir yapay zeka modeli eğitti: yani CGVQM. Yapay zeka modelinin kullanılması, gerçek zamanlı grafik çıktılarının kalitesini değerlendirme ve derecelendirme sürecini daha ölçeklenebilir hale getiriyor.

Yapay zeka modelinin insan gözüyle uyumlu sonuçlar verdiğinden emin olmak için araştırmacılar, öncelikle yeni video veri setini bir grup insan gözlemciye sundular. Gözlemcilerden, videolardaki çeşitli bozulmaların algılanan şiddetini "algılanamaz" ile "çok rahatsız edici" arasında bir ölçekte derecelendirmeleri istendi. Bu, bir kalite temel çizgisi oluşturmak için kullanıldı.

Ardından, araştırmacılar, bu bozulmaları insan gözlemcilerle rekabet edebilecek şekilde tanımlayabilen bir sinir ağı eğitmeye odaklandı. Görüntü kalitesi değerlendirme modeli için bir temel olarak Evrişimli Sinir Ağı (CNN) mimarisini ve özellikle bir Artık Sinir Ağı'nı (ResNet) tercih ettiler. Çalışmalarının temelini 3D-ResNet-18 modeli oluştururken, bu model ilgilenilen bozulmaları tanımak için özel olarak eğitildi ve kalibre edildi.

Araştırmanın raporuna göre, yüksek performans elde etmek için 3 boyutlu bir ağ seçimi kritik öneme sahipti. 3 boyutlu ağ, yalnızca girdi çerçevesindeki piksel düzeni gibi uzamsal (2B) desen bilgilerini değil, aynı zamanda zamansal desen bilgilerini de dikkate alabiliyor.

Kullanımda, CGVQM modelinin kendi veri setinde diğer benzer görüntü kalitesi değerlendirme araçlarından daha iyi performans gösterdiği iddia ediliyor. CGVQM-5 modeli, CGVQD video kataloglarının insan temelli değerlendirmesinin hemen ardından gelirken, daha basit CGVQM-2 modeli ise test edilen modeller arasında üçüncü sırada yer alıyor.

Araştırmacılar, modellerinin sadece CGVQD'deki bozulmaları belirleme ve yerelleştirme konusunda iyi performans göstermekle kalmayıp, aynı zamanda eğitim setinin bir parçası olmayan videolara da genelleme yapabildiğini gösteriyor. Bu genelleme yeteneği, modelin gerçek zamanlı grafik uygulamalarından gelen görüntü kalitesini değerlendirme konusunda geniş çapta kullanışlı bir araç haline gelmesi için kritik öneme sahip.

Araştırmacılar, bu yapay zeka tabanlı yaklaşımı geliştirmek için birkaç olası yol daha belirliyor. Bunlardan biri, performansı daha da artırmak için transformatör sinir ağı mimarisini kullanmak. Diğeri ise optik akış vektörleri gibi bilgileri dahil ederek görüntü kalitesi değerlendirmesini iyileştirmek olarak belirtiliyor. Mevcut haliyle bile, CGVQM modelinin gücü, gerçek zamanlı grafik çıktılarının değerlendirilmesinde heyecan verici bir ilerleme olduğunu gösteriyor.