Nvidia'nın yeni nesil Vera Rubin tabanlı sunucu raflarının fiyatlarının, mevcut Blackwell tabanlı raflara kıyasla artacağı ve özellikle Rubin Ultra ile bu artışın zirveye ulaşacağı belirtiliyor. Rubin Ultra'nın bir raftaki GPU paket sayısını ikiye katlayacağı düşünülüyor. Bu durum, Nvidia'nın karlılığını artırırken, iş ortaklarının kar marjlarının ise daralmasına neden oluyor. Bu durumun yalnızca milyonlarca dolarlık ürünlerde yüzde 10 kar marjını korumanın zorluğundan değil, aynı zamanda Nvidia'nın sunucu üreticileri ve sistem entegratörlerinin nihai maliyet tablosundaki rolünü azaltma eğiliminden de kaynaklandığı ifade ediliyor.

Milyonlarca Dolar Rak Ölçekli Sistemler

Mevcut bilgilere göre, Yapay Zeka eğitimi ve HPC (Yüksek Başarımlı Hesaplama) için optimize edilmiş Blackwell tabanlı NVL72 GB200 GB200 raf ölçekli sistemlerin fiyatı 2,8 ila 3,4 milyon dolar arasında değişirken, Yapay Zeka çıkarımı (inference) için optimize edilmiş NVL72 GB300 sistemleri ise 6 ila 6,5 milyon dolar civarında fiyatlandırılıyor.

Öte yandan, Vera Rubin tabanlı NVL72 VR200 sistemlerinin şu anda birim başına 5 milyon ila 7 milyon dolar arasında fiyatlandırıldığı, bu sistemlerin yaklaşık 1 milyon dolarlık 3D NAND depolama birimiyle birlikte geldiği belirtiliyor. İnternette görülen bazı fiyat tekliflerinin geçerliliği olsa da, bunların birçoğunun genellikle uygun bir garanti olmaksızın yalnızca ODM (Orijinal Tasarım Üreticisi) fiyatlarını yansıtabileceği unutulmamalıdır.

Vera Rubin Ultra'nın henüz piyasaya sürülmediği göz önüne alındığında, NVL144 VR300 sistemleri için teklif alan çok fazla şirket bulunmuyor. Ancak, yapılan raporlara göre NVL144 VR300 raf ölçekli sistemlerin fiyatlarının, raporlara bağlı olarak 7 milyon dolardan 8,8 milyon dolara kadar çıkabileceği söyleniyor. Nvidia, NVL72 veya NVL144 ürünlerinin liste fiyatlarını hiçbir zaman doğrulamamıştır.

Bu rakamlar arasındaki fark, kesin sayılar konusunda temkinli olmamız gerektiğini açıkça gösteriyor, ancak sayıların büyüklüğü, yüz binlerce dolar yerine milyonlarca dolarlık sistemlerle karşı karşıya olduğumuzu gösteriyor.

Bu tür artışlar genellikle Nvidia ve Astera Labs gibi raf başına yüzlerce parça tedarik eden küçük retimer üreticilerinden, Micron veya TSMC gibi büyük HBM4 tedarikçilerine kadar kilit silikon tedarikçileri için olumludur. TSMC'deki Nvidia silikonunun artan maliyetlerinin yanı sıra daha pahalı HBM4 belleği de göz önüne alındığında, Vera Rubin makinelerinin Blackwell sistemlerinden daha pahalı olmasının birçok başka nedeni de bulunuyor.

Yeni sistemler, önceki nesillerine göre önemli ölçüde daha karmaşıktır. Daha fazla güç tüketirler ve daha pahalı bileşenler gerektirirler. Daha da önemlisi, tüm Vera Rubin tabanlı NVL72 VR200 sistemleri depolama ile birlikte geldiğinden, bu da maliyetlerine yaklaşık bir milyon dolar ekleyerek 3D NAND bellek üreticilerine fayda sağlıyor.

Gerçek Sunucu Üreticileri Karlı Kalmakta Zorlanıyor

Nvidia ve diğer çip üreticileri Yapay Zeka alanında büyük karlar elde ederken, aynı şeyi gerçek sistem tedarikçileri için söylemek mümkün değil. Nvidia'nın, ortaklarına tamamen monte edilmiş Seviye-10 (L10) hesaplama tepsileri tedarik etmeyi planladığı ve bu sayede sunucunun çekirdek tasarımının ve üretiminin büyük bir kısmını devralacağı bildiriliyor.

Bireysel bileşenler yerine, Nvidia'nın Vera CPU, Rubin GPU'lar, bellek, ağ bağlantısı, güç kaynağı ve sıvı soğutmayı içeren önceden monte edilmiş tepsi modülleri teslim etmeyi planladığı belirtiliyor. Bu, önceki GB200 yaklaşımının (L7–L8 entegrasyonu) ötesine geçerek neredeyse tüm hesaplama alt sistemini standartlaştıracaktır. Bu tepsiler bir sunucunun maliyetinin yaklaşık %90'ını oluşturabileceğinden, ODM'ler ve büyük veri merkezleri artık anakart veya soğutma sistemlerini kendileri tasarlamayacak, yalnızca raf düzeyinde entegrasyon, güç altyapısı, soğutma dağıtımı (örneğin, CDU'lar) ve yönetim yazılımlarına odaklanacaklardır. Bu durum şüphesiz sıkıntılarını azaltırken, kar marjlarını da azaltıyor ve bu da doğal olarak memnuniyet verici bir durum değil. ODM'ler, kar marjlarının yanı sıra Nvidia'nın sunduğunun ötesinde farklılaşma ve yenilik yapma yeteneklerini de kaybediyorlar, bu da rekabet edebilmeleri için tek yolun karlılıkları pahasına fiyatları düşürmek olduğu anlamına geliyor.

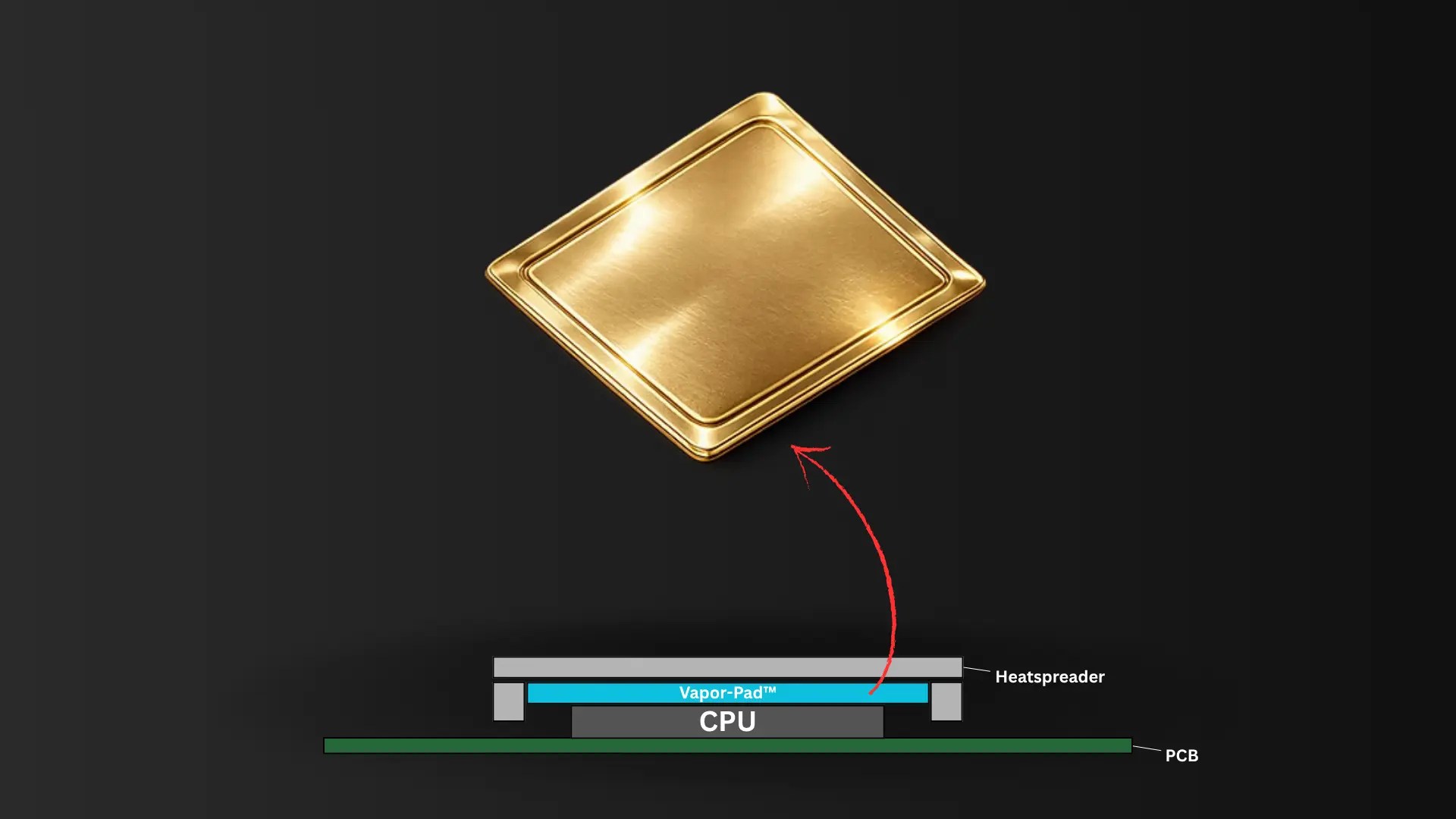

Önceden monte edilmiş tepsileri sunucu üreticilerine göndermek, dağıtım sürelerini hızlandırabilir ve geliştirme maliyetlerini düşürebilir, çünkü Nvidia bu karmaşık sistemleri büyük EMS (Elektronik Üretim Hizmetleri) ortaklarının (muhtemelen Foxconn, Quanta veya Wistron) kitlesel üretimine güvenecektir. Bu durum, özellikle çok kalın PCB'ler, yüksek yoğunluklu tasarımlar ve GPU'ların artan güç tüketimi (Blackwell Ultra için 1,4 kW'tan 1,8 kW'a ve potansiyel olarak daha yükseğe çıkması bekleniyor) gibi yeni nesil donanımın artan mühendislik zorlukları göz önüne alındığında oldukça önemlidir. Bu da sıkı entegre soğutma çözümlerine olan ihtiyacı artırıyor.

Ancak bu değişim, ODM'lerin rolünü de yeniden tanımlayarak, onları sistem tasarımcılarından entegratör ve hizmet sağlayıcılara dönüştürecek, aynı zamanda Nvidia'nın değer zinciri üzerindeki kontrolünü ve kar marjlarını artıracaktır.

İlerleyen dönemde, bu strateji, Kyber NVL576 (Kyber şasisi, paket başına hesaplama çiplet sayısını ikiye katlayarak GPU paket sayısını ikiye katlar) gibi raf ölçekli sistemlere daha da genişleyebilir. Özellikle sektör 800V'luk veri merkezi mimarilerine ve megawatt sınıfı raflara doğru ilerledikçe, Nvidia'nın nihayetinde kontrolünü tepsilerin ötesine tam raf düzeyinde entegrasyona kadar genişletme, ODM'lerin rolünü daha da azaltma ve kar marjlarını daha da daraltma olasılığı artmaktadır.