NVIDIA'nın Groq'un LPU (Linear Processing Unit) birimlerine yönelik planları teknoloji dünyasında merak konusu. Şirketin CEO'su Jensen Huang, son finansal değerlendirme toplantısında bu konuya değinerek geleceğe dair ipuçları verdi.

NVIDIA'nın Groq LPU'ları Düşük Gecikme Gerektiren İş Yüklerinde Şirketin Konumunu Güçlendirecek

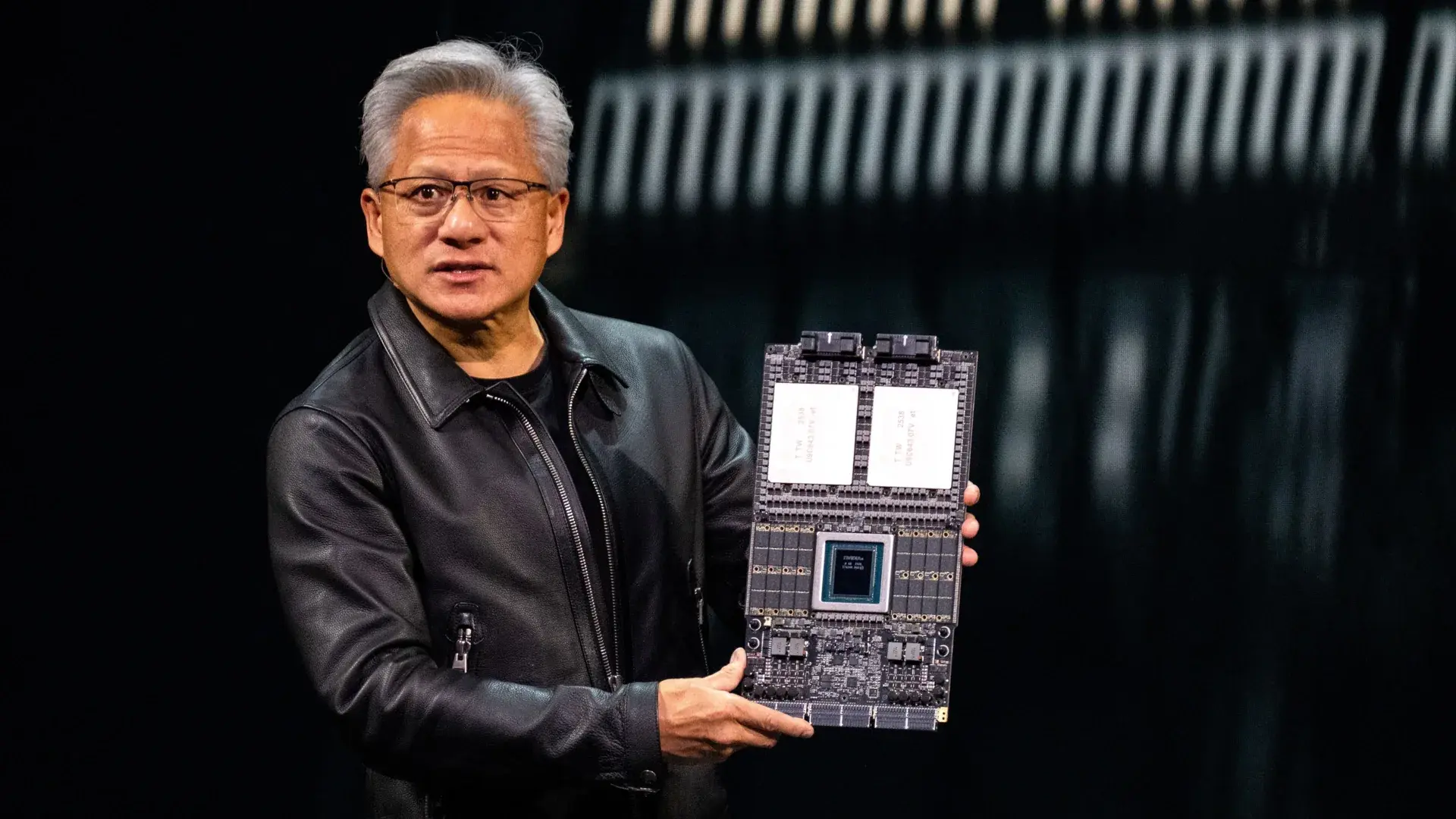

NVIDIA, bu yıl agresif bir satın alma stratejisi izliyor. Bu stratejinin en dikkat çekici adımlarından biri ise Groq ile yapılan ve değeri 20 milyar dolara kadar ulaşabilen, lisanssız bir anlaşma oldu. Bu yatırım, NVIDIA'nın bugüne kadarki en büyük yatırımı olarak kayıtlara geçti. Anlaşma duyurusunun yılbaşı gecesine denk gelmesi ve NVIDIA'nın sonrasında detaylı planlarını paylaşmaması merakları artırmıştı. Son finansal değerlendirme toplantısında NVIDIA CEO'suna Groq ile ilgili ne gibi planları olduğu sorulduğunda, Huang'ın verdiği yanıt LPU'ların NVIDIA'nın yapay zeka çözümlerindeki rolüne dair önemli ipuçları sundu.

Groq'un satın alınmasındaki temel fikir oldukça basit: NVIDIA, özellikle düşük gecikme süresi gerektiren iş yüklerine odaklanmak istiyor. Günümüzde yapay zeka çıkarım (inference) aşaması büyük önem kazanmış durumda. Yapay zeka ajanlarının çalıştığı ortamlarda anlık ve ultra hızlı yanıtlar kritik hale geliyor. Bu durum, gecikmeyi hesaplama sağlayıcıları için önemli bir darboğaz haline getiriyor. NVIDIA, Hopper ve Blackwell mimarileriyle eğitim (training) alanında hakimiyet kurmuş olsa da, çıkarım aşamasında henüz tam bir liderlik kurmuş değil. İşte bu noktada Groq'un LPU birimleri, sektörde yeni bir standart belirlemede kilit rol oynayacak gibi görünüyor.

NVIDIA CEO'su Jensen Huang, Groq'un rolünü şirketin geçmişteki 'Mellanox' satın almasına benzetti. Mellanox'un ağ altyapısındaki sorunları çözdüğünü ve InfiniBand teknolojisinin temelini oluşturduğunu hatırlayacak olursak, bu satın almanın NVIDIA'nın veri merkezi stratejisine büyük katkı sağladığı biliniyor. Benzer şekilde Groq'un da NVIDIA'nın mimarisini genişleteceği ve LPU'ların veri merkezi ölçeğinde bir entegrasyonla karşımıza çıkacağı öngörülüyor.

Yapay zeka çıkarım sürecinin temel aşamaları 'kod çözme' (decode) ve 'ön doldurma' (prefill) olarak biliniyor. Özellikle ajan tabanlı yapay zeka sistemlerinde, kod çözme aşaması çok daha büyük bir önem taşıyor. Çünkü çoklu ajan içeren iş yüklerinde, ajanların karmaşık akıl yürütme adımlarını saniyeler içinde tamamlaması gerekiyor. Dünya, birbirine bağımlı yapay zeka ajanlarının oluşturduğu 'sürüler'e doğru ilerledikçe bu hız hayati önem kazanıyor. NVIDIA, Vera Rubin CPX ile dikkat hızlandırma motorları ve NVFP4 hesaplama gücü sayesinde ön doldurma aşamalarını büyük ölçüde ele almış durumda.

Kod çözme aşaması için ise NVIDIA'nın Groq'tan yararlanacağı Jensen Huang tarafından belirtildi. LPU'lar, kendi çipleri içindeki SRAM bellekleri sayesinde saniyede on terabaytlarca bant genişliği sunabiliyor. Daha önce Cerebras'ın WSE-3 ve Microsoft'un Maia 300 gibi ürünlerinde de SRAM teknolojisinin yaygın olarak kullanıldığını görmüştük. LPU'ların nerede entegre edileceği konusunda iki ana teori bulunuyor. İlkine göre NVIDIA, tek bir veri merkezi rafı içinde birden fazla LPU'yu birleşik bir ara bağlantı ile birbirine bağlayarak hibrit hesaplama düğümleri tasarlayabilir.

GF Securities'in bir analizine göre NVIDIA, bu yıl düzenlenecek GTC etkinliğinde tek bir ünitede 256 LPU barındıran bir 'LPX rafı' tanıtılabilir. Bu bilgiye dayanarak, LPU'lar arası bağlantılarda NVIDIA'nın yerel plesiosynchronous çipten çipe protokolünü kullanması bekleniyor. LPU'lardan GPU'lara bağlantıda ise ön doldurma aşamasında GPU'lardan büyük miktarda KV önbellek (cache) boşaltımını yönetmek için NVLink Fusion teknolojisinin kullanılabileceği düşünülüyor. Diğer bir seçenek ise LPU'ların Feynman GPU'ları içine hibrit bağlama yoluyla yerleştirilmesi olsa da, şu an için raf ölçeğindeki entegrasyon daha olası bir senaryo olarak öne çıkıyor.

Özetle, Groq'un LPU birimlerinin ağ altyapısındaki Mellanox'un rolüne benzer bir görev üstleneceği ve bu hibrit mimarinin NVIDIA'ya düşük gecikme süresi gerektiren iş yüklerinde önemli bir avantaj sağlayacağı düşünülüyor. Jensen Huang'ın belirttiği gibi, yapay zeka uygulama katmanının hızla gelişmesiyle birlikte hesaplama gücü ve gelir büyümesi birebir paralel ilerliyor. NVIDIA'nın LPU'lara yönelik resmi planlarını bu yılki GTC etkinliğinde açıklaması bekleniyor.