Üretken yapay zeka modellerinin çalışma prensiplerine çok hakim olmasanız bile, bu modellerin ciddi miktarda belleğe ihtiyaç duyduğunu muhtemelen biliyorsunuzdur. Bu durum, günümüzde bilgisayar parçası alırken bütçenin önemli bir kısmının RAM'e ayrılmasına neden oluyor. Google Araştırma ekibi, büyük dil modellerinin (LLM) bellek gereksinimlerini önemli ölçüde azaltırken, aynı zamanda hızı artıran ve doğruluğu koruyan bir sıkıştırma algoritması olan TurboQuant'ı duyurdu.

TurboQuant, LLM'lerin daha az bellek kullanmasını sağlamak amacıyla tasarlanmış olup, özellikle yeniden hesaplama yapmadan önemli bilgileri saklayan bir tür “dijital kopya kağıdı” olarak tanımlanan anahtar-değer önbelleğini (key-value cache) küçültmeyi hedefliyor. LLM'lerin aslında bilgiye sahip olmaması, bunun yerine metinleri vektörlere dönüştürerek anlamsal benzerliği temsil etmesi ve bu sayede bilgiyi taklit etmesi, bu önbelleğin önemini ortaya koyuyor. İki vektörün benzerliği, kavramsal bir yakınlık anlamına geliyor.

Yüzlerce, hatta binlerce gömme içerebilen yüksek boyutlu vektörler, bir görüntünün pikselleri veya büyük bir veri kümesi gibi karmaşık bilgileri temsil edebilir. Ancak bu vektörler aynı zamanda çok fazla bellek tüketir ve anahtar-değer önbelleğinin boyutunu şişirerek performansı yavaşlatır. Modelleri daha küçük ve verimli hale getirmek için geliştiriciler, modelleri daha düşük hassasiyette çalıştırmak amacıyla niceleme (quantization) tekniklerini kullanır. Ancak bu durum, çıktılarda düşüşe ve token tahmin kalitesinin azalmasına yol açar. TurboQuant ile Google'ın ilk sonuçları, bazı testlerde kalite kaybı olmaksızın 8 kat performans artışı ve 6 kat bellek kullanımı azalması gösteriyor.

Açı ve Hataların Giderilmesi

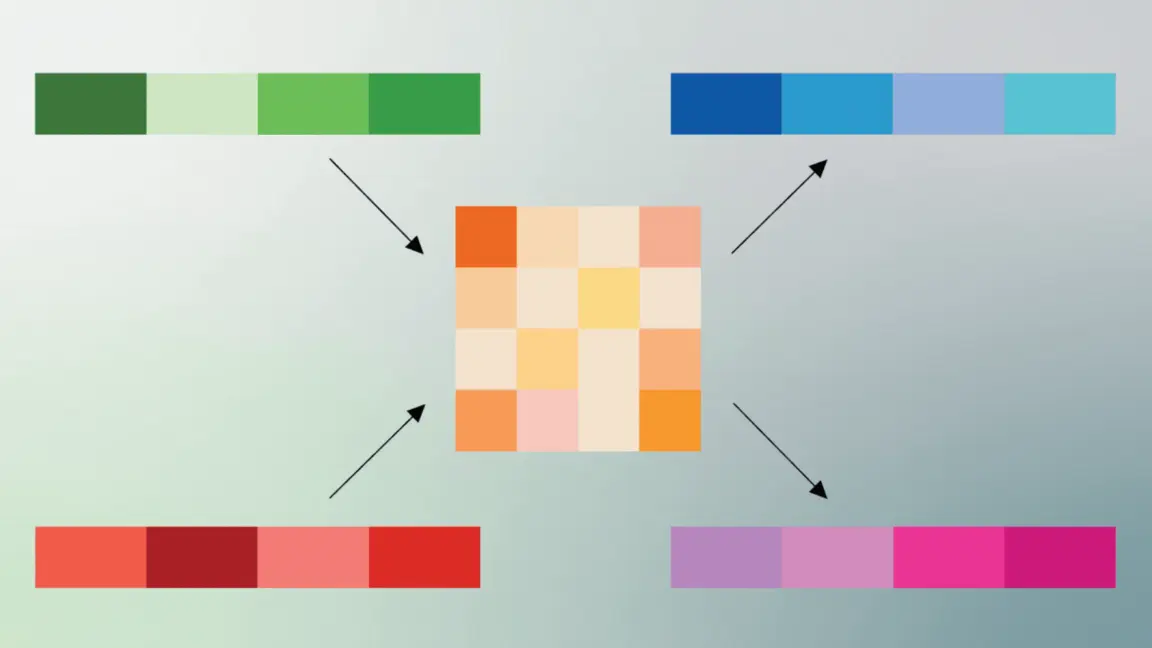

TurboQuant'ı bir yapay zeka modeline uygulamak iki adımlı bir süreçtir. Yüksek kaliteli sıkıştırma elde etmek için Google, PolarQuant adını verdiği bir sistem geliştirmiştir. Genellikle yapay zeka modellerindeki vektörler standart Kartezyen koordinatlar kullanılarak kodlanır. PolarQuant ise vektörleri Kartezyen sistemdeki kutupsal koordinatlara dönüştürür. Bu dairesel ızgarada vektörler, yarıçap (çekirdek veri gücü) ve yön (verinin anlamı) olmak üzere iki bilgi parçasına indirgenir.

Google, bu süreci açıklamak için ilgi çekici bir benzetme sunuyor. Vektör koordinatları yönlere benzetilebilir. Geleneksel kodlama “3 blok Doğu'ya, 4 blok Kuzey'e git” şeklinde olabilir. Ancak kutupsal koordinatlar kullanıldığında bu, basitçe “37 derecelik bir açıyla 5 blok git” haline gelir. Bu, daha az yer kaplar ve sistemin pahalı veri normalleştirme adımlarından kaçınmasını sağlar.

PolarQuant sıkıştırmanın büyük bir kısmını gerçekleştirirken, ikinci adımda ortaya çıkan pürüzler giderilir. PolarQuant etkili olsa da, artık hatalar (residual errors) oluşturabilir. Google, Quantized Johnson-Lindenstrauss (QJL) adlı bir teknikle bu hataları yumuşatmayı öneriyor. Bu yöntem, modele 1-bit hata düzeltme katmanı uygulayarak her vektörü tek bir bitte (+1 veya -1) düşürürken, ilişkileri tanımlayan temel vektör verisini korur. Sonuç, sinir ağlarının hangi verinin önemli olduğuna karar verdiği temel süreç olan dikkat skorunda (attention score) daha doğru bir hale gelir. Daha fazla detayla ilgileniyorsanız, ön baskı makalesine indirilebilir.

Peki tüm bu matematiksel işlemler işe yarıyor mu? Google, yeni algoritmik sıkıştırmayı Gemma ve Mistral açık modellerini kullanarak bir dizi uzun bağlam karşılaştırması üzerinde test ettiğini belirtiyor. TurboQuant, tüm testlerde anahtar-değer önbelleğindeki bellek kullanımını 6 kat azaltırken, downstream sonuçlarda kusursuz bir performans sergilemiş. Algoritma, ek bir eğitime gerek kalmadan önbelleği yalnızca 3 bite kadar niceleyebiliyor, böylece mevcut modellere uygulanabiliyor. 4-bit TurboQuant ile dikkat skorunun hesaplanması, Nvidia H100 hızlandırıcıları üzerinde 32-bit nicelenmemiş anahtarlara kıyasla 8 kat daha hızlıdır.

TurboQuant uygulanırsa, yapay zeka modellerinin çalıştırılması daha ucuz hale gelebilir ve bellek iştahları azalabilir. Ancak bu teknolojiyi geliştiren şirketler, bu yeni açığa çıkan belleği daha karmaşık modelleri çalıştırmak için de kullanabilir. Muhtemelen her ikisinin bir karışımı olacaktır, ancak mobil yapay zeka daha fazla fayda görebilir. Bir akıllı telefonun donanımsal kısıtlamaları göz önüne alındığında, TurboQuant gibi sıkıştırma teknikleri, verilerinizi buluta göndermeden çıktı kalitesini artırabilir.