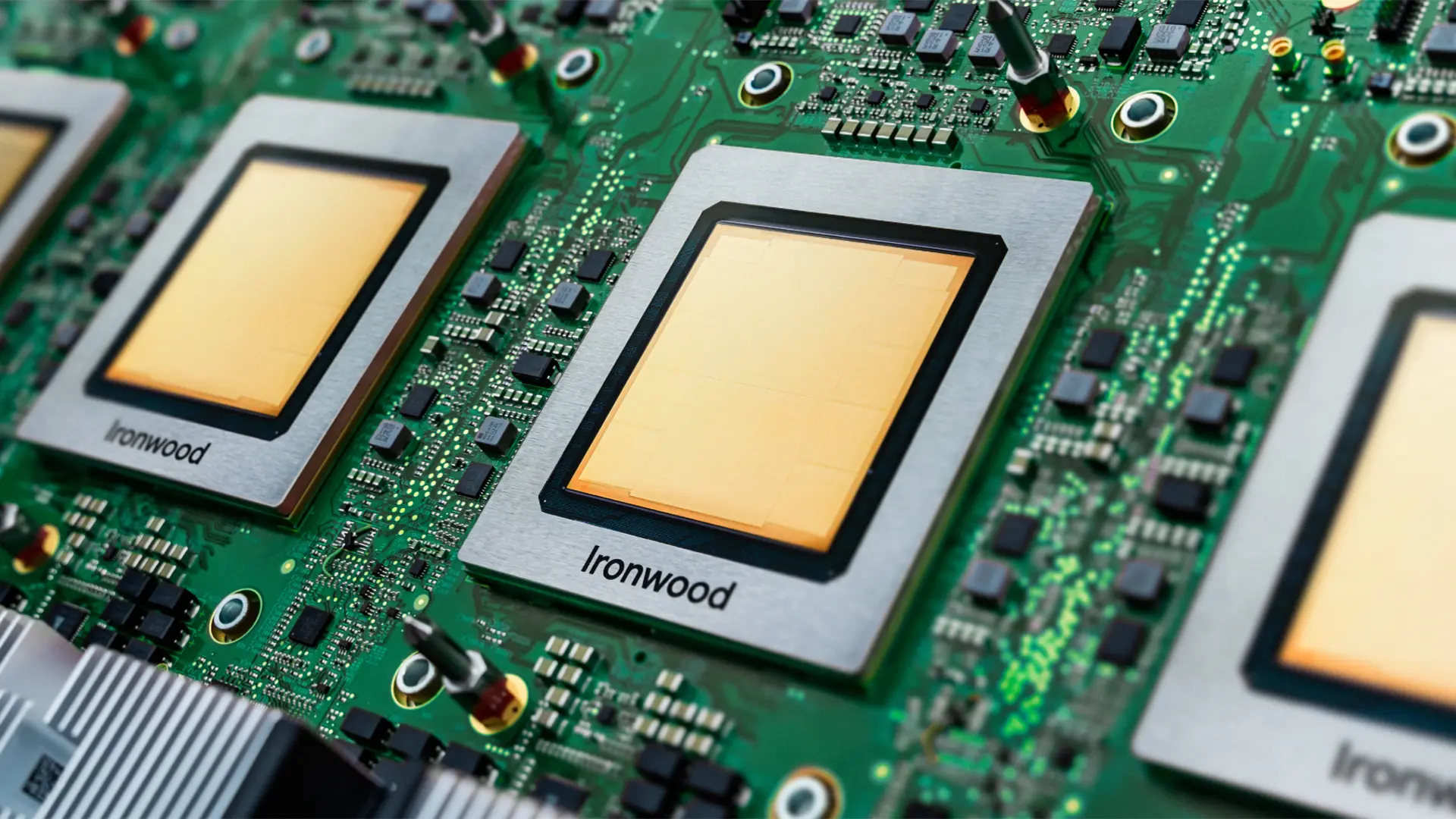

Google Cloud, yapay zeka odaklı yeni örneklerini duyurdu. Bu örnekler, Google'ın kendi geliştirdiği Axion CPU'lar ve Ironwood TPU'lar ile güçlendiriliyor. Yeni örnekler, büyük ölçekli yapay zeka modellerinin eğitim ve düşük gecikmeli çıkarım işlemleri için tasarlanırken, temel özelliklerinden biri de Google'ın Ironwood tabanlı sistemlerinin sunduğu çok büyük ölçekli dünya boyutu ile yapay zeka modellerinin verimli bir şekilde ölçeklenmesini sağlamasıdır.

Milyonlarca Ironwood TPU ile Eğitim ve Çıkarım

Google'ın 7. Nesil tensor işlem birimi (TPU) olan Ironwood, 4.614 FP8 TFLOPS'luk bir performans sunuyor ve 192 GB HBM3E belleğe sahip. Bu bellek, 7.37 TB/s'ye kadar bellek bant genişliği sağlıyor. Ironwood pod'ları, 9.216 yapay zeka hızlandırıcısına kadar ölçeklenebiliyor ve eğitim ile çıkarım için toplam 42.5 FP8 ExaFLOPS'luk bir güç sunuyor. Bu değer, Nvidia'nın GB300 NVL72 sisteminin 0.36 ExaFLOPS'luk FP8 kapasitesini önemli ölçüde geride bırakıyor. Pod'lar, özel olarak geliştirilmiş 9.6 Tb/s'lik bir yongalar arası ara bağlantı ağı ile birbirine bağlanıyor ve toplamda yaklaşık 1.77 PB HBM3E bellek taşıyor. Bu da yine Nvidia'nın rakip platformunun sunduğundan daha fazlası anlamına geliyor.

Axion CPU'lar ve Ironwood TPU'lar üzerine kurulu Ironwood pod'ları, yüz binlerce TPU'nun çalıştığı kümeler halinde birleştirilebiliyor. Bu kümeler, Google'ın yapay zeka için özel olarak tasarladığı "AI Hypercomputer"ın bir parçası haline geliyor. AI Hypercomputer, hesaplama, depolama ve ağ bağlantısını tek bir yönetim katmanı altında birleştiren entegre bir süperbilgisayar platformu olarak öne çıkıyor. Hem ultra büyük pod'ların hem de AI Hypercomputer'ın güvenilirliğini artırmak için Google, donanım kesintilerini anında yönlendirerek sürekli çalışmayı sağlayan "Optical Circuit Switching" adlı yeniden yapılandırılabilir bir yapı kullanıyor.

IDC verilerine göre, AI Hypercomputer modeli kurumsal müşteriler için ortalama %353 üç yıllık yatırım getirisi (ROI), %28 daha düşük BT harcaması ve %55 daha yüksek operasyonel verimlilik sağlıyor.

Bazı şirketler şimdiden Google'ın Ironwood tabanlı platformunu kullanmaya başladı. Anthropic, Claude model ailesini çalıştırmak ve genişletmek için bir milyon adede kadar TPU kullanmayı planladığını belirtiyor. Lightricks de Ironwood'u LTX-2 çok modlu sistemini eğitmek ve sunmak için kullanmaya başladı.

Axion CPU'lar: Google Kendi Tasarımı İşlemcilerini Sunuyor

Google'ın Ironwood gibi yapay zeka hızlandırıcıları dikkat çekse de, CPU'lar uygulama mantığı, hizmet barındırma ve veri alımı gibi yapay zeka iş yüklerinin bir kısmı için kritik öneme sahip. Bu nedenle, Google 7. Nesil TPU'larının yanı sıra, ilk Armv9 tabanlı genel amaçlı işlemcileri olan Axion'u da kullanıma sunuyor.

Google, Axion CPU'ların tam yonga özelliklerini henüz yayınlamadı. Ancak, Arm Neoverse v2 platformu üzerine kurulu olan Axion'un, modern x86 CPU'lara kıyasla %50'ye kadar daha yüksek performans ve %60'a kadar daha yüksek enerji verimliliği sunması hedefleniyor. Ayrıca buluttaki en hızlı genel amaçlı Arm tabanlı örneklerden %30 daha yüksek performans iddia ediliyor. Bazı bilgilere göre, CPU çekirdek başına 2 MB özel L2 önbellek, 80 MB L3 önbellek, DDR5-5600 MT/s bellek ve düğümler için Uniform Memory Access (UMA) desteği sunuyor.

Google'ın Axion CPU'ları ve Ironwood TPU'ları ile donatılmış sunucular, şirketin özel Titanium markalı denetleyicileriyle geliyor. Bu denetleyiciler, ağ, güvenlik ve I/O depolama işlemlerini ana CPU'dan devralarak daha iyi yönetim ve daha yüksek performans sağlıyor.

Axion CPU'lar, hem yapay zeka sunucuları hem de genel amaçlı sunucular için çeşitli görevlerde kullanılabiliyor. Google şu anda C4A, N4A ve C4A metal olmak üzere üç Axion yapılandırması sunuyor.

C4A, Google'ın Axion destekli örnek ailesinin ilk ve ana ürünü olup, genel kullanıma açık ilk yapılandırmadır. 72'ye kadar vCPU, 576 GB DDR5 bellek ve 100 Gbps ağ bağlantısı sunarken, 6 TB'a kadar yerel kapasiteli Titanium SSD depolama ile geliyor. Bu örnek, çeşitli uygulamalarda sürekli yüksek performans için optimize edilmiştir.

N4A örneği, veri işleme, web hizmetleri ve geliştirme ortamları gibi genel iş yükleri için tasarlanmıştır. 64'e kadar vCPU, 512 GB DDR5 RAM ve 50 Gbps ağ bağlantısı ile daha uygun fiyatlı bir seçenek sunuyor.

Diğer önizleme modeli olan C4A Metal ise, muhtemelen müşterilere doğrudan tam Axion donanım yığınını sunan bir bare-metal yapılandırmasıdır. 96'ya kadar vCPU, 768 GB DDR5 bellek ve 100 Gbps ağ bağlantısı ile gelir. Bu örnek, özel veya lisans kısıtlamalı uygulamalar ya da Arm tabanlı geliştirme için tasarlanmıştır.

Özel Silikonlardan Oluşan Tam Bir Portföy

Bu yeni ürünler, orijinal TPU ile başlayan ve YouTube'un VCU'ları, Tensor mobil işlemcileri ve Titanium altyapısı ile devam eden bir on yıllık özel silikon geliştirme sürecinin üzerine inşa edilmiştir. Google'ın ilk Arm tabanlı genel amaçlı sunucu işlemcisi olan Axion CPU, şirketin özel çiplerinin portföyünü tamamlıyor. Ironwood TPU ise piyasadaki en iyi yapay zeka hızlandırıcılarıyla rekabet için zemin hazırlıyor.